Warum enthalten KI-generierte Bilder immer Tippfehler? Zerlegen Sie das Modell,

AI 测评室

4. Mai 2026

Sie haben vielleicht festgestellt, dass die von KI gezeichneten Bilder

Sie haben vielleicht festgestellt: Die von KI gezeichneten Bilder werden immer besser, aber die Wörter in den Bildern sind oft falsch. Das ist kein Zufall, sondern ein strukturelles Problem.

Eine verrückte Szene

Sie nutzen KI, um ein schönes Werbeplakat zu erstellen. Die Komposition ist perfekt, die Farbabstimmung ist fortgeschritten und Licht und Schatten sind natürlich. Dann schauen Sie genauer hin – „SUMMER SALE“ wird als „SUMMER SAIE“ geschrieben, oder dem Wort „Hui“ im chinesischen Titel „Limited Time Special Offer“ fehlt eine horizontale Linie.

Du hast dich einmal regeneriert. Diesmal ist „SALE“ korrekt, aber das Datum im Untertitel ist unleserlich.

Du versuchst es noch einmal. Das Datum ist korrekt, aber der Zeichenabstand ist plötzlich groß und klein und das Gesamtlayout sieht aus wie ein Betrunkener.

Das liegt nicht daran, dass Ihre Aufforderungsworte nicht gut geschrieben sind, und auch nicht daran, dass das Modell zu schlecht ist. Dies ist ein struktureller Mangel der aktuellen KI-Bilderzeugungstechnologie – und er wird so schnell nicht verschwinden.

In diesem Artikel wird das Problem aufgeschlüsselt, auf fünf Ebenen erklärt, „warum die Wörter immer falsch geschrieben werden“ und Ihnen dann erklärt, warum es normalerweise nicht die beste Lösung ist, sie von der KI umschreiben zu lassen.

Die erste Ursachenebene: Das Modell „erkennt“ das Wort überhaupt nicht

Die meisten Leute denken, dass KI-Modelle „zuerst Text verstehen und ihn dann zeichnen“. Dies ist nicht der Fall.

Gängige Bilderzeugungsmodelle (Stabile Diffusion, DALL-E, Flux usw.) verwenden die BPE-Wortsegmentierung – eine Codierungsmethode, die Text in „Wortfragmente“ schneidet. BPE ist gut darin, Semantik zu verstehen („Dies ist ein Poster“), aber nicht gut darin, Glyphen präzise zu steuern („Dieser Buchstabe ist ein E, kein F“).

Was noch problematischer ist, ist, dass die Textencoder in diesen Modellen – ob CLIP oder T5 – nicht dafür ausgelegt sind, „Zeichen präzise zu zeichnen“. CLIP bevorzugt die „Konzeptausrichtung“ (das Verstehen der Entsprechung zwischen Bildern und Text) und T5 das „Sprachverstehen“ (das Verstehen der Bedeutung von Sätzen). Keines von beiden ist für die „Textwiedergabe auf Pixelebene“ konzipiert.

Zum Beispiel: Lassen Sie eine Person mit gutem Verständnis, aber schlechten Schreibfähigkeiten mit geschlossenen Augen einen Text auf eine Leinwand kopieren. Er weiß ungefähr, was er schreiben möchte, aber die Striche, der Abstand und die Größe jedes Wortes sind unterschiedlich. Dies ist der Grundzustand des aktuellen Modells zur Textverarbeitung.

Das bedeutet: Unabhängig davon, wie Sie die Eingabeaufforderungswörter optimieren, hat die Genauigkeit der Textsteuerung des Modells natürlich eine Obergrenze. Diese Obergrenze kann durch die „Prompt-Wort-Technik“ nicht überschritten werden.

Die zweite Ursachenebene: das Fehlen von „Glyphenpaaren“ in den Trainingsdaten

Auch wenn das Modell in der Lage ist, Text genau wiederzugeben, erfordert es zum Lernen eine große Menge an „Text-Glyphen“-gepaarten Trainingsdaten. Das Problem ist, dass derart hochwertige Daten rar sind.

Tatsächlich gibt es in realen Bildern viel Text – Straßenschilder, Verpackungen, Poster, Bücher –, aber die Schriftartanmerkung dieses Textes ist fast nicht vorhanden. Das Modell weiß, dass „dieses Bild Wörter enthält“, aber es weiß nicht, „welche Schriftart, welche Stärke und welcher Abstand für dieses Wort verwendet wird“.

Das Ergebnis ist: Das Modell kann lernen, „die Wörter grob zu zeichnen“, aber es kann nicht lernen, „den Schriftstil präzise zu steuern“. Dies führt direkt zu einer Verschiebung des Schriftstils. Wenn Sie nach serifenloser Schriftart fragen, erhalten Sie eine ungefähre Serife. Wenn Sie in derselben Zeile nach der gleichen Dicke fragen, erhalten Sie eine dickere oder dünnere.

Noch ernster ist die Situation auf Chinesisch. Es gibt Tausende häufig verwendeter chinesischer Schriftzeichen und die Strichkomplexität ist viel höher als die lateinischer Buchstaben, aber chinesische Textanmerkungen in den Trainingsdaten sind noch seltener. Dies erklärt, warum viele Modelle auf Englisch „ok“ sind, auf Chinesisch jedoch „häufig falsch“.

Die dritte Ursachenebene: Die Layoutkontrolle ist zu schwach

Ein Text in einem Bild besteht nicht nur aus „ein paar Wörtern“, sondern beinhaltet eine Reihe geometrischer Beziehungen wie Position, Größe, Zeilenabstand, Zeichenabstand, Ausrichtung, Grundlinie usw. Aktuelle Modelle haben eine schlechte Kontrolle über diese geometrischen Beziehungen.

In einfachen Szenarien ist das nicht offensichtlich – eine große Überschrift, ein Markenname, damit kommt das Model meist klar. Sobald es jedoch zu mehrzeiligem Text, mehreren Textfeldern und unterschiedlichen Schriftgraden kommt, treten Probleme auf:

- Wörter sind manchmal weit entfernt und manchmal nahe beieinander und der Zeilenabstand ist inkonsistent

- Links- und Rechtsfehlausrichtung, Grundliniendrift

- Die relative Position mehrerer Textfelder ist falsch

- Die Qualität des Textes in der hinteren Zeile langer Absätze wird deutlich reduziert

Die akademische Gemeinschaft bezeichnet diese Probleme kollektiv als „Langtext“- und „Mehrere Textfelder“-Probleme, die derzeit anerkannte Schwierigkeiten sind. Forschungen wie EasyText und BizGen konzentrieren sich speziell auf „Langtext“, „Mehrfachtext“ und „unregelmäßige Bereiche“, was wiederum zeigt, dass die Stabilität dieser Szenarien noch lange nicht gelöst ist.

Praktische Auswirkungen: Wenn Ihre Figur nur eine einzeilige Beschriftung benötigt, kann KI die Arbeit erledigen. Wenn Ihr Bild über fünf oder sechs Textebenen verfügt (Titel, Untertitel, Zeit, Ort, Verkaufsargument, Handlungsaufforderung) und jede Ebene präzise eingegeben werden muss, steigt die Fehlerquote der KI dramatisch an.

Die vierte Ursache: Die Komprimierung des latenten Raums ist für kleine Zeichen nicht geeignet

Das Diffusionsmodell arbeitet nicht direkt im Pixelraum, sondern erzeugt diesen in einem komprimierten „latenten Raum“. Dies ist sehr benutzerfreundlich für große Objekte (Landschaften, Menschen, Produkte) – spart Videospeicher, spart Rechenleistung und sorgt für hohe Effizienz.

Beim Kleingedruckten bedeutet die Latentraumkomprimierung jedoch den Verlust hochfrequenter Details. Text mit dünnen Strichen, harten Kanten und extrem geringer Fehlertoleranz kann während des Komprimierungs- und Wiederherstellungsprozesses auftreten:

- Verschwommene oder gebrochene Striche

- gezackte Kanten

- Nach dem Vergrößern erscheinen „falsche Details“ – Striche, die wie Wörter aussehen, aber tatsächlich vom Modell „eingebildet“ wurden

Dies erklärt ein häufiges Phänomen: KI-generierte große Schlagzeilen sind oft gut, kleine Texte (Preis, Zutaten, Haftungsausschluss) sind jedoch oft unscharf oder verzerrt. Es ist nicht so, dass das Modell kleine Zeichen nicht gut schreiben möchte, sondern dass die Auflösung des latenten Raums das Ausmaß einschränkt, in dem es kleine Zeichen gut schreiben „kann“.

Logik der Lösung: Korrigieren Sie zuerst die Wörter und vergrößern Sie sie dann. Wenn Sie zuerst vergrößern und dann die Zeichen korrigieren, füllt das Modell während des Vergrößerungsvorgangs mehr fehlerhafte Strichdetails aus, was die Reparatur erschwert.

Die fünfte Ursachenebene: Auch Identifizierung und Vorverarbeitung können Sie täuschen

Selbst wenn die von der KI generierten Wörter „fast richtig“ aussehen, kann es zu Problemen kommen, wenn Sie sie mit einem OCR-Tool überprüfen. Das ist nicht die Schuld des OCR-Tools, aber die Bildvorverarbeitung wurde nicht gut gemacht.

In der offiziellen Tesseract-Dokumentation werden vier Dinge eindeutig als wichtige Vorverarbeitung für den Erfolg oder Misserfolg der OCR aufgeführt: Neuskalierung (Skalierung), Binarisierung (Binarisierung), Rauschunterdrückung und Entzerrung (Korrektur). PaddleOCR fügt drei zusätzliche Schalter hinzu: Richtungsklassifizierung, Textbildkorrektur und Textzeilenrichtungsklassifizierung.

Mit anderen Worten: Die Ursache vieler „OCR-Erkennungsfehler“ ist nicht der Erkenner selbst, sondern die Geometrie und Vorverarbeitung des Bildes. Ein Bild, das um 2 Grad verzerrt ist, ein Textbereich mit unzureichendem Kontrast, ein Textabschnitt mit zu weichem Anti-Aliasing – all das kann dazu führen, dass OCR völlig falsche Ergebnisse liefert.

Praktische Vorschläge: Führen Sie vor der Verwendung von OCR zur Überprüfung von KI-generiertem Text die folgenden Vorverarbeitungen durch: Stellen Sie sicher, dass der Kontrast im Textbereich ausreichend ist, das Bild nicht wesentlich geneigt ist und die Textränder nicht übermäßig unscharf sind. Dies ist viel effektiver als der Wechsel zu einem größeren OCR-Modell.

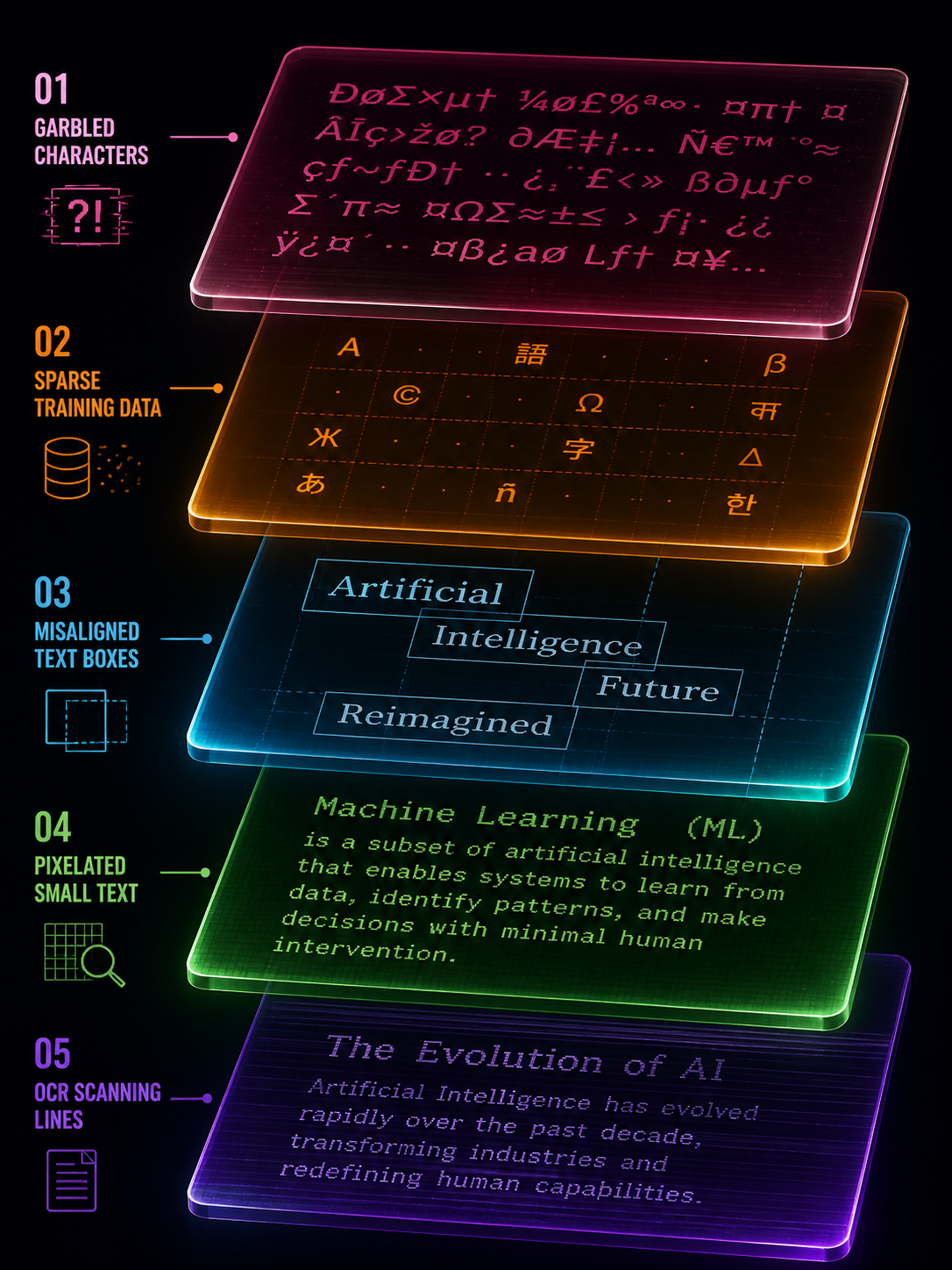

Die Realität nach der Überlagerung von fünf Ursachenebenen

Stapeln Sie die fünf Ebenen und Sie werden verstehen, warum „KI-Schreiben“ so schwierig ist:

- Der Textencoder des Modells ist nicht für präzise Glyphen ausgelegt

- Mangel an qualitativ hochwertigen Trainingsdaten für die Paarung von Glyphen und Schriftarten

- Schwache geometrische Kontrollfähigkeit des Multitext-Layouts

- Die Komprimierung des latenten Raums ist für hochfrequente Details kleiner Zeichen nicht geeignet.

- Eine unsachgemäße Bildvorverarbeitung führt zu Fehlern bei der Überprüfung

Diese fünfschichtigen Probleme sind keine Mängel eines bestimmten Modells, sondern strukturelle Einschränkungen des gesamten Paradigmas der Diffusionsbilderzeugung. GPT Image 2 ist bei der Textwiedergabe viel besser als sein Vorgänger, aber diese zugrunde liegenden Einschränkungen sind nicht verschwunden – sie wurden nur teilweise gemildert.

Ist „die KI es einmal umschreiben lassen“ sinnvoll?

Nützlich, aber begrenzt.

Bei kurzen Anzeigebegriffen (Titel mit drei bis fünf Wörtern, Markennamen) ist es tatsächlich möglich, mit der Regeneration eine korrekte Version zu „treffen“. Dabei handelt es sich jedoch im Wesentlichen um ein Wahrscheinlichkeitsspiel – jede Generation ist ein unabhängiger Ausloser und die Konvergenz ist nicht garantiert.

Bei langen Texten, mehreren Textfeldern und komplexen Layouts wird eine Neugenerierung das Problem selten beheben. Denn die Ursache liegt nicht in der „Zufälligkeit“, sondern in der strukturellen Obergrenze der Modellfähigkeiten. Man versucht es zehnmal noch einmal, und vielleicht macht man an verschiedenen Stellen zehnmal einen Fehler.

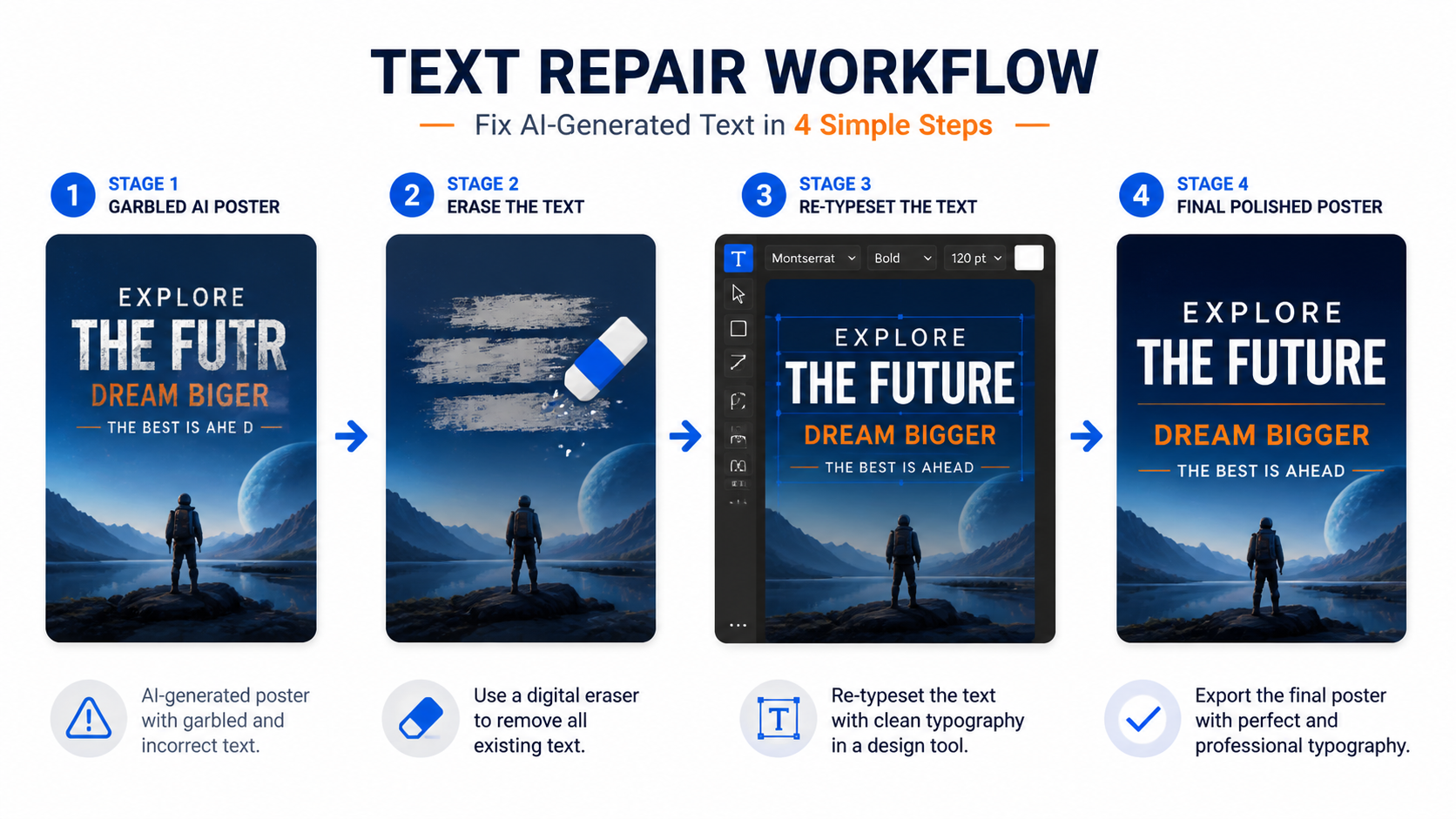

Ein stabilerer Ansatz besteht darin, den von der KI generierten Text als „Skizze“ zu behandeln – Sie erhalten einen groben Stil, ein grobes Layout und eine Atmosphäre, aber der Text selbst muss einen Nachbearbeitungsprozess mit „Löschen – Erkennen/Korrekturlesen – Neuanordnen – Exportieren“ durchlaufen.

Dies bedeutet nicht „KI ist nicht gut“, sondern „KI ist für die Teile verantwortlich, in denen sie gut ist (visueller Stil), und Menschen und Werkzeuge sind für die Teile verantwortlich, in denen KI nicht gut ist (präziser Text)“.

Risikostufen in verschiedenen Szenarien

Nicht jeder Text erfordert den gleichen Grad an Nachbearbeitung. Je nach Risikostufe:

Geringes Risiko: Dekorativer Text für Postertitel, Social-Media-Grafiken. Diese Art von Text ist ästhetischer, solange er „richtig aussieht“. KI direkt + Sichtprüfung ist in der Regel ausreichend. Sie können auch versuchen, kurze Anzeigewörter mit Inpaint zu korrigieren.

Mittleres Risiko: Markenname, Veranstaltungsname, Datum, Preis. Diese Art von Text erfordert „wirklich richtig“, aber es gibt nicht viele Wörter. Es wird empfohlen, die OCR-Überprüfung + manuelle Überprüfung zu verwenden und die Fehler vor Ort zu bearbeiten.

Hohes Risiko: Zutatenlisten, Vorschriftentext, mehrsprachige Etiketten, Infografikdaten. Diese Art von Text weist eine äußerst geringe Fehlertoleranz auf und ein einzelner Buchstaben- oder Zahlenfehler kann zu rechtlichen Problemen führen. Standardmäßig startet es den Prozess „OCR-Extraktion + Vektorneuanordnung + Element-für-Element-Korrekturlesen“ und setzt nicht darauf, dass die KI alles auf einmal richtig macht.

Der Beurteilungsmaßstab ist sehr einfach: Plakattitel können „so aussehen, als wären sie richtig angeordnet“; Beschriftungen und Infografiken müssen „wirklich richtig angeordnet“ sein.

Zusammenfassung in einem Satz

Die von KI erzeugten Textfehler sind kein Zufall, sondern die Überlagerung von fünfschichtigen Strukturproblemen wie Textkodierung, Trainingsdaten, Layoutkontrolle, Latentraumkomprimierung und Vorverarbeitung. Die stabilste Strategie besteht nicht darin, es immer wieder zu versuchen, sondern den KI-Text als Skizze zu behandeln und den Nachbearbeitungsprozess „Löschen-Erkennen-Neuanordnen“ zu verwenden, um ihn zu korrigieren.

Möchten Sie den tatsächlichen Unterschied in der Textwiedergabe zwischen verschiedenen Modellen sehen? Sie können mehrere Modelle mit demselben Eingabeaufforderungswort auf gpt-image-2.live ausführen und die Textgenauigkeit vergleichen – Sie werden feststellen, dass die Lücke größer ist, als Sie denken.

![[de] Transforming Production Workflows with GPT Image 2 Capabilities](https://gpt-image-2.live/blog-assets/f7f88ae7fe45ba37/hero-replicate.webp)