¿Por qué las imágenes generadas por IA siempre contienen errores tipográficos?

AI 测评室

4 de mayo de 2026

Es posible que haya descubierto que las imágenes dibujadas por la IA son cada vez mejores, pero las palabras en las imágenes a menudo son incorrectas. Esto no es un accidente: es un problema estructural.

Quizás lo hayas descubierto: las imágenes dibujadas por IA son cada vez mejores, pero las palabras en las imágenes a menudo son incorrectas. Esto no es un accidente: es un problema estructural.

Una escena loca

Utiliza IA para generar un hermoso cartel promocional. La composición es perfecta, la combinación de colores es avanzada y la luz y las sombras son naturales. Luego, mira más de cerca: "OFERTA DE VERANO" está escrito como "SAIE DE VERANO", o a la palabra "Hui" en el título chino "Oferta especial por tiempo limitado" le falta una línea horizontal.

Te regeneraste una vez. Esta vez "OFERTA" es correcto, pero la fecha en el subtítulo está confusa.

Inténtalo de nuevo. La fecha es correcta, pero el espacio entre caracteres de repente es grande y pequeño, y el diseño general parece un borracho.

Esto no se debe a que sus palabras clave no estén bien escritas, ni a que el modelo sea una lástima. Esta es una deficiencia estructural de la tecnología actual de generación de imágenes mediante IA, y no desaparecerá pronto.

Este artículo desglosará el problema, explicará "por qué las palabras siempre se escriben incorrectamente" en cinco niveles y luego le dirá por qué "dejar que la IA las reescriba" generalmente no es la mejor solución.

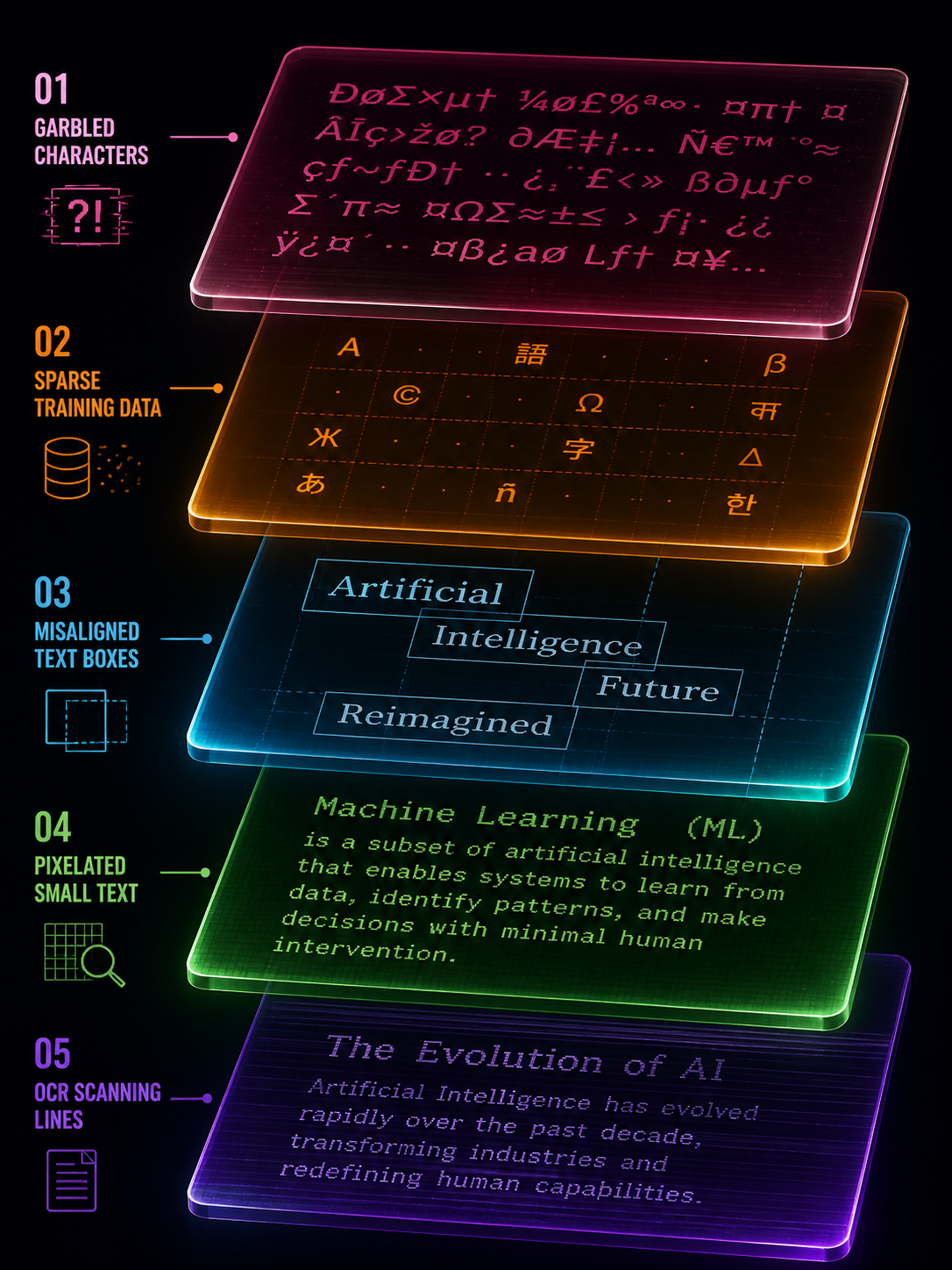

El primer nivel de causa: el modelo no "reconoce" la palabra en absoluto

La mayoría de la gente piensa que los modelos de IA "primero entienden el texto y luego lo dibujan". Este no es el caso.

Los modelos convencionales de generación de imágenes (Stable Diffusion, DALL-E, Flux, etc.) utilizan la segmentación de palabras BPE, un método de codificación que corta el texto en "fragmentos de palabras". BPE es bueno para comprender la semántica ("Esto es un cartel"), pero no es bueno para controlar con precisión los glifos ("Esta letra es una E, no una F").

Lo que es aún más problemático es que los codificadores de texto de estos modelos (ya sean CLIP o T5) no están diseñados para "dibujar caracteres con precisión". CLIP favorece la "alineación de conceptos" (comprender la correspondencia entre imágenes y texto) y T5 favorece la "comprensión del lenguaje" (comprender el significado de las oraciones). Ninguno de los dos está diseñado para la "representación de texto a nivel de píxeles".

Por ejemplo: deje que una persona con gran comprensión pero pocas habilidades de escritura copie un fragmento de texto en un lienzo con los ojos cerrados. Sabe aproximadamente lo que quiere escribir, pero los trazos, el espaciado y el tamaño de cada palabra son todos diferentes. Este es el estado básico del modelo actual para procesar texto.

Esto significa: No importa cómo optimice las palabras clave, la precisión del control de texto del modelo naturalmente tiene un límite superior. Este límite superior no puede superarse mediante la "técnica de la palabra rápida".

El segundo nivel de causa: la falta de "pares de glifos" en los datos de entrenamiento

Incluso si el modelo es capaz de representar texto con precisión, requiere una gran cantidad de datos de entrenamiento emparejados "texto-glifo" para aprender. El problema es que esos datos de alta calidad son escasos.

De hecho, hay mucho texto en imágenes del mundo real (letreros de calles, envases, carteles, libros), pero la anotación tipográfica de este texto es casi inexistente. El modelo sabe "hay palabras en esta imagen", pero no sabe "qué fuente, qué peso y qué espaciado se utiliza para esta palabra".

El resultado es: el modelo puede aprender a "dibujar las palabras de forma aproximada", pero no puede aprender a "controlar con precisión el estilo de fuente". Esto conduce directamente a una variación del estilo de fuente: si solicita sans-serif, le dará una serif aproximada; si pides el mismo grosor en la misma línea te dará uno más grueso o más fino.

La situación en China es aún más grave. Hay miles de caracteres chinos de uso común y la complejidad de los trazos es mucho mayor que la de las letras latinas, pero las anotaciones de texto chino en los datos de entrenamiento son aún más escasas. Esto explica por qué muchos modelos son "correctos" en inglés pero "frecuentemente incorrectos" en chino.

La tercera capa de causas: el control de diseño es demasiado débil

Un fragmento de texto en una imagen no son sólo "unas pocas palabras", sino que implica un conjunto de relaciones geométricas como posición, tamaño, interlineado, espaciado entre caracteres, alineación, línea base, etc. Los modelos actuales tienen poco control sobre estas relaciones geométricas.

Esto no es obvio en escenarios simples: un gran titular, una marca, el modelo generalmente puede manejarlo. Pero una vez que se convierte en texto de varias líneas, múltiples cuadros de texto y diferentes niveles de composición tipográfica, surgen problemas:

- Las palabras a veces están lejanas y a veces cercanas, y el interlineado es inconsistente

- Desalineación izquierda y derecha, deriva de la línea base

- La posición relativa de varios cuadros de texto es incorrecta.

- La calidad del texto en la última fila de párrafos largos se reduce significativamente

La comunidad académica se refiere a estos problemas colectivamente como "texto largo" y "múltiples cuadros de texto", que actualmente son dificultades reconocidas. Investigaciones como EasyText y BizGen se centran específicamente en "texto largo", "texto múltiple" y "áreas irregulares", lo que demuestra que la estabilidad de estos escenarios está lejos de resolverse.

Impacto práctico: Si tu figura solo necesita un título de una línea, la IA puede hacer el trabajo. Si su imagen tiene cinco o seis niveles de texto (título, subtítulo, hora, lugar, punto de venta, llamado a la acción) y cada nivel debe escribirse con precisión, la tasa de falla de la IA aumenta dramáticamente.

La cuarta capa de causa: la compresión del espacio latente no es amigable para los caracteres pequeños

El modelo de difusión no funciona directamente en el espacio de píxeles, sino que lo genera en un "espacio latente" comprimido. Esto es muy amigable para objetos grandes (paisajes, personas, productos): ahorra memoria de video, ahorra energía informática y alta eficiencia.

Pero para la letra pequeña, la compresión del espacio latente significa la pérdida de detalles de alta frecuencia. Es probable que aparezca texto con trazos finos, bordes duros y una tolerancia a errores extremadamente baja durante el proceso de compresión y restauración:

- Trazos borrosos o rotos

- bordes dentados

- Aparecen "detalles falsos" después de hacer zoom: trazos que parecen palabras pero que en realidad son "imaginados" por el modelo

Esto explica un fenómeno común: los grandes titulares generados por IA suelen ser buenos, pero los textos pequeños (precio, ingredientes, exenciones de responsabilidad) suelen aparecer borrosos o distorsionados. No es que el modelo "no quiera" escribir bien caracteres pequeños, es que la resolución del espacio latente limita hasta qué punto "puede" escribir bien caracteres pequeños.

Lógica de la solución: Primero corrija las palabras y luego amplíelas. Si amplía primero y luego corrige los caracteres, el modelo "rellenará mentalmente" más detalles de trazos erróneos durante el proceso de ampliación, lo que hará que sea más difícil de reparar.

La quinta capa de causas: la identificación y el preprocesamiento también pueden engañarte

Incluso si las palabras generadas por la IA parecen "casi correctas", puede haber problemas cuando se utiliza una herramienta de OCR para verificarlas. Esto no es culpa de la herramienta OCR, pero el preprocesamiento de la imagen no se realizó bien.

La documentación oficial de Tesseract enumera claramente cuatro cosas como preprocesamiento clave para el éxito o el fracaso del OCR: reescalado (escalado), binarización (binarización), eliminación de ruido y enderezamiento (corrección). PaddleOCR agrega tres interruptores adicionales: clasificación de dirección, corrección de imagen de texto y clasificación de dirección de línea de texto.

En otras palabras, la causa fundamental de muchos "errores de reconocimiento de OCR" no es el reconocedor en sí, sino la geometría y el preprocesamiento de la imagen. Una imagen torcida 2 grados, un área de texto con contraste insuficiente, un fragmento de texto con suavizado demasiado suave: todo esto puede hacer que el OCR produzca resultados completamente incorrectos.

Sugerencias prácticas: Antes de usar OCR para verificar el texto generado por IA, realice estos preprocesamientos: asegúrese de que el contraste en el área del texto sea suficiente, que la imagen no esté significativamente inclinada y que los bordes del texto no estén excesivamente borrosos. Esto es mucho más eficaz que cambiar a un modelo de OCR más grande.

La realidad tras superponer cinco capas de causas

Junte las cinco capas y comprenderá por qué la "escritura con IA" es tan difícil:

- El codificador de texto del modelo no está diseñado para glifos precisos.

- Falta de datos de entrenamiento de emparejamiento de fuentes y glifos de alta calidad

- Débil capacidad de control geométrico del diseño de texto múltiple

- La compresión del espacio latente no es compatible con los detalles de alta frecuencia de caracteres pequeños.

- El preprocesamiento inadecuado de la imagen provocará errores en la verificación

Estos problemas de cinco capas no son defectos de un determinado modelo, sino limitaciones estructurales de todo el paradigma de generación de imágenes de difusión. GPT Image 2 es mucho mejor en la representación de texto que su predecesor, pero estas limitaciones subyacentes no han desaparecido: solo se han aliviado parcialmente.

¿Es útil "dejar que la IA lo reescriba una vez"?

Útil, pero limitado.

Para términos de visualización cortos (títulos de 3 a 5 palabras, nombres de marcas), es posible "obtener" una versión correcta con regeneración. Pero esto es esencialmente un juego de probabilidad: cada generación es un sorteo independiente y la convergencia no está garantizada.

Para textos largos, múltiples cuadros de texto y diseños complejos, la regeneración rara vez mejorará el problema. Porque la causa fundamental no es la "aleatoriedad", sino el límite superior estructural de las capacidades del modelo. Lo intentas de nuevo 10 veces y tal vez 10 veces te equivoques en diferentes lugares.

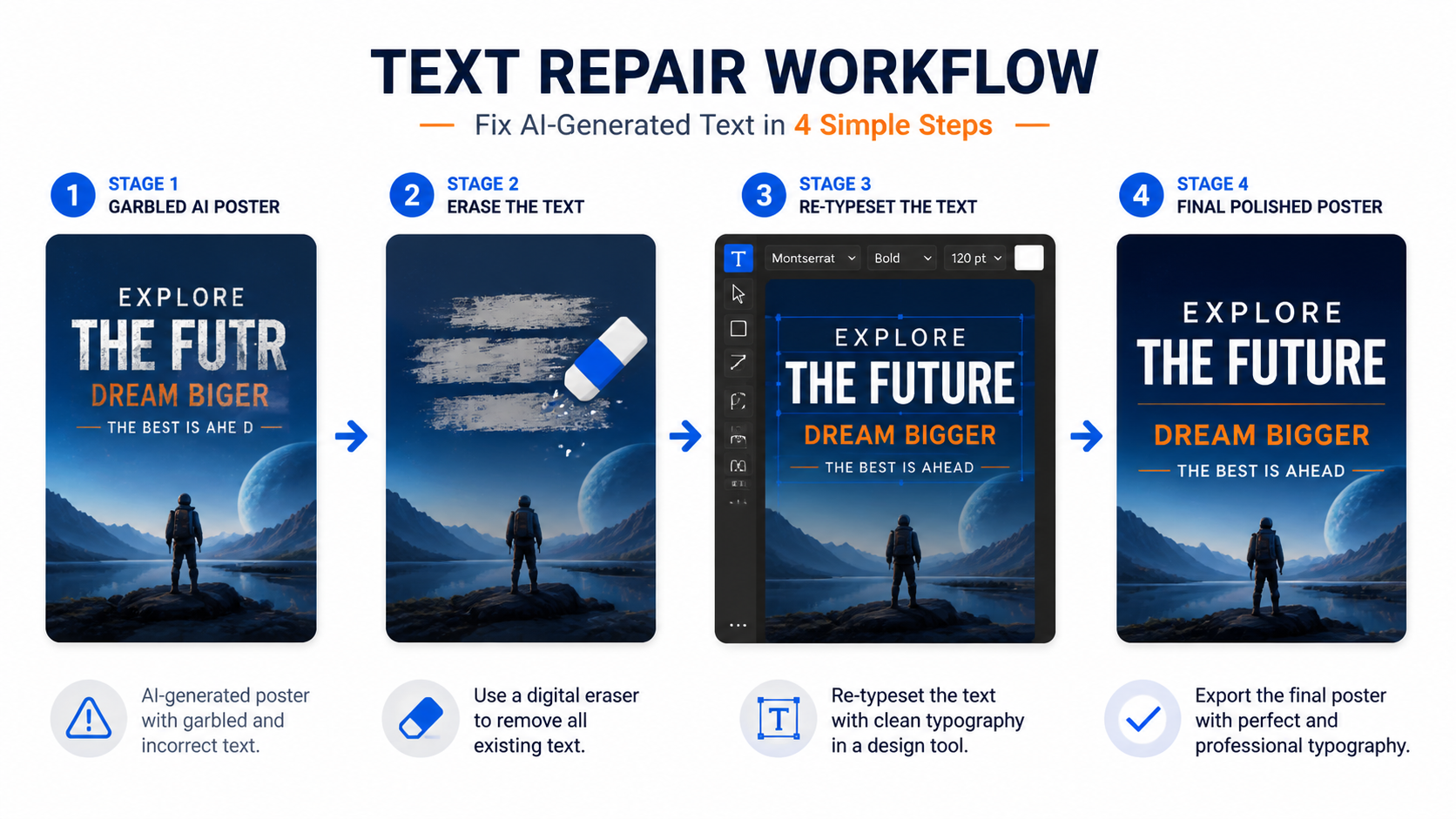

Un enfoque más estable es tratar el texto generado por la IA como un "boceto": proporciona un estilo, un diseño y una atmósfera aproximados, pero el texto en sí debe entrar en un proceso de posprocesamiento de "borrado - reconocimiento/corrección - reorganización - exportación".

Esto no es "la IA no es buena", sino "la IA es responsable de las partes en las que es buena (estilo visual), y las personas y las herramientas son responsables de las partes en las que la IA no es buena (texto preciso)".

Niveles de riesgo en diferentes escenarios

No todo el texto requiere el mismo nivel de posprocesamiento. Según nivel de riesgo:

Bajo riesgo: texto decorativo para títulos de carteles, gráficos de redes sociales. Este tipo de texto es más estético, siempre y cuando "quede bien". La IA directa + inspección visual suele ser suficiente. También puede intentar utilizar inpaint para corregir palabras breves que se muestran.

Riesgo medio: marca, nombre del evento, fecha, precio. Este tipo de texto requiere "muy bien", pero no hay muchas palabras. Se recomienda utilizar verificación OCR + revisión manual y utilizar la edición local para reparar errores.

Alto riesgo: listas de ingredientes, texto reglamentario, etiquetas multilingües, datos infográficos. Este tipo de texto tiene una tolerancia a errores extremadamente baja y un error de una sola letra o número puede generar problemas legales. De forma predeterminada, ingresa al proceso de "extracción de OCR + reordenamiento de vectores + revisión elemento por elemento" y no apuesta a que la IA lo haga bien de una vez.

El estándar de evaluación es muy simple: Se puede permitir que los títulos de los carteles "parezcan estar organizados correctamente"; Las etiquetas e infografías deben exigir "realmente dispuestas correctamente".

Resumen de una oración

Los errores en el texto generado por la IA no son accidentales, sino la superposición de problemas estructurales de cinco capas, como la codificación de texto, los datos de entrenamiento, el control de diseño, la compresión del espacio latente y el preprocesamiento. La estrategia más estable no es volver a intentarlo una y otra vez, sino tratar el texto de IA como un boceto y utilizar el proceso de posprocesamiento de "borrar-reconocer-reorganizar" para corregirlo.

¿Quiere ver la diferencia real en la representación de texto entre diferentes modelos? Puede ejecutar varios modelos usando la misma palabra en gpt-image-2.live y comparar la precisión del texto; encontrará que la brecha es mayor de lo que cree.

![[es] Transforming Production Workflows with GPT Image 2 Capabilities](https://gpt-image-2.live/blog-assets/f7f88ae7fe45ba37/hero-replicate.webp)