Pourquoi les images générées par l’IA contiennent-elles toujours des fautes

AI 测评室

4 mai 2026

Vous avez peut-être découvert que les images dessinées par l'IA s'améliorent

Vous l'avez peut-être découvert : les images dessinées par l'IA sont de mieux en mieux, mais les mots dans les images sont souvent faux. Ce n’est pas un accident, c’est un problème structurel.

Une scène folle

Vous utilisez l'IA pour générer une belle affiche promotionnelle. La composition est parfaite, la correspondance des couleurs est avancée et la lumière et l'ombre sont naturelles. Ensuite, regardez de plus près : « SUMMER SALE » s'écrit « SUMMER SAIE », ou le mot « Hui » dans le titre chinois « Limited Time Special Offer » n'a pas de ligne horizontale.

Vous vous êtes régénéré une fois. Cette fois, « SALE » est correct, mais la date dans le sous-titre est devenue tronquée.

Vous réessayez. La date est correcte, mais l'espacement des caractères est soudainement grand et petit, et la disposition générale ressemble à un ivrogne.

Ce n’est pas parce que vos mots d’invite ne sont pas bien écrits, ni parce que le modèle est trop mauvais. Il s’agit d’une lacune structurelle de la technologie actuelle de génération d’images IA, et elle ne disparaîtra pas de sitôt.

Cet article décomposera le problème, expliquera « pourquoi les mots sont toujours mal écrits » à partir de cinq niveaux, puis vous expliquera pourquoi « laisser l'IA le réécrire » n'est généralement pas la meilleure solution.

Le premier niveau de cause : le modèle ne « reconnaît » pas du tout le mot

La plupart des gens pensent que les modèles d’IA « comprennent d’abord le texte, puis le dessinent ». Ce n'est pas le cas.

Les modèles de génération d'images grand public (Stable Diffusion, DALL-E, Flux, etc.) utilisent la segmentation de mots BPE - une méthode de codage qui coupe le texte en « fragments de mots ». BPE est doué pour comprendre la sémantique (« Ceci est une affiche »), mais pas pour contrôler précisément les glyphes (« Cette lettre est un E, pas un F »).

Ce qui est encore plus gênant, c'est que les encodeurs de texte de ces modèles, qu'ils soient CLIP ou T5, ne sont pas conçus pour « dessiner des caractères avec précision ». CLIP favorise « l'alignement des concepts » (compréhension de la correspondance entre les images et le texte), et T5 favorise la « compréhension du langage » (compréhension du sens des phrases). Ni l'un ni l'autre n'est conçu pour le "rendu de texte au niveau des pixels".

Par exemple : laissez une personne ayant une bonne compréhension mais de faibles compétences en écriture copier un morceau de texte sur une toile les yeux fermés. Il sait à peu près ce qu’il veut écrire, mais les traits, l’espacement et la taille de chaque mot sont tous différents. Il s’agit de l’état de base du modèle actuel de traitement de texte.

Cela signifie : Quelle que soit la manière dont vous optimisez les mots d'invite, la précision du contrôle de texte du modèle a naturellement une limite supérieure. Cette limite supérieure ne peut pas être dépassée par la "technique du mot d'invite".

Le deuxième niveau de cause : le manque de "paires de glyphes" dans les données d'entraînement

Même si le modèle est capable de restituer du texte avec précision, son apprentissage nécessite une grande quantité de données d'entraînement appariées « texte-glyphe ». Le problème est que des données de cette qualité sont rares.

Il y a en effet beaucoup de texte dans des images du monde réel – panneaux de signalisation, emballages, affiches, livres – mais les annotations de police de ce texte sont quasiment inexistantes. Le modèle sait « il y a des mots dans cette image », mais il ne sait pas « quelle police, quel poids et quel espacement est utilisé pour ce mot ».

Le résultat est le suivant : le modèle peut apprendre à « dessiner grossièrement les mots », mais il ne peut pas apprendre à « contrôler avec précision le style de police ». Cela conduit directement à une dérive du style de police - si vous demandez sans empattement, cela vous donnera un empattement approximatif ; si vous demandez la même épaisseur sur la même ligne, cela vous en donnera une plus épaisse ou plus fine.

La situation en chinois est encore plus grave. Il existe des milliers de caractères chinois couramment utilisés et la complexité des traits est bien supérieure à celle des lettres latines, mais les annotations de texte chinois dans les données d'entraînement sont encore plus rares. Cela explique pourquoi de nombreux modèles sont « ok » en anglais mais « souvent faux » en chinois.

Troisième couche de causes : le contrôle de la mise en page est trop faible

Un morceau de texte dans une image ne se résume pas à « quelques mots », il implique un ensemble de relations géométriques telles que la position, la taille, l'espacement des lignes, l'espacement des caractères, l'alignement, la ligne de base, etc. Les modèles actuels ont un faible contrôle sur ces relations géométriques.

Ce n'est pas évident dans des scénarios simples : un gros titre, un nom de marque, le modèle peut généralement le gérer. Mais une fois qu'il s'agit d'un texte multiligne, de plusieurs zones de texte et de différents niveaux de composition, des problèmes surviennent :

- Les mots sont parfois éloignés et parfois proches, et l'espacement des lignes est incohérent

- Désalignement gauche et droit, dérive de la ligne de base

- La position relative de plusieurs zones de texte est erronée

- La qualité du texte de la dernière rangée de longs paragraphes est considérablement réduite

La communauté universitaire les qualifie collectivement de problèmes de « texte long » et de « zones de texte multiples », qui sont actuellement des difficultés reconnues. Des recherches comme EasyText et BizGen se concentrent spécifiquement sur le « texte long », le « texte multiple » et les « zones irrégulières », ce qui montre en soi que la stabilité de ces scénarios est loin d'être résolue.

Impact pratique : Si votre figurine n'a besoin que d'une légende d'une seule ligne, l'IA peut faire le travail. Si votre image comporte cinq ou six niveaux de texte (titre, sous-titre, heure, lieu, argument de vente, appel à l’action) et que chaque niveau doit être saisi avec précision, le taux d’échec de l’IA augmente considérablement.

La quatrième couche de cause : la compression de l'espace latent n'est pas adaptée aux petits caractères

Le modèle de diffusion ne fonctionne pas directement dans l'espace des pixels, mais le génère dans un « espace latent » compressé. Ceci est très convivial pour les objets volumineux (paysages, personnes, produits) - économisant de la mémoire vidéo, économisant de la puissance de calcul et une efficacité élevée.

Mais pour les petits caractères, la compression de l’espace latent signifie la perte de détails à haute fréquence. Le texte avec des traits fins, des bords nets et une tolérance d'erreur extrêmement faible est susceptible d'apparaître pendant le processus de compression et de restauration :

- Traits flous ou cassés

- bords irréguliers

- Des "faux détails" apparaissent après un zoom avant - des traits qui ressemblent à des mots mais qui sont en réalité "imaginés" par le modèle

Cela explique un phénomène courant : les gros titres générés par l'IA sont souvent bons, mais les petits textes (prix, ingrédients, clauses de non-responsabilité) sont souvent flous ou déformés. Ce n'est pas que le modèle "ne veut pas" bien écrire les petits caractères, c'est que la résolution de l'espace latent limite la mesure dans laquelle il "peut" bien écrire les petits caractères.

Logique de la solution : Corrigez d'abord les mots, puis agrandissez-les. Si vous agrandissez d'abord puis corrigez les caractères, le modèle « remplira le cerveau » de détails de trait plus erronés pendant le processus d'agrandissement, ce qui rendra la réparation plus difficile.

Le cinquième niveau de causes : l'identification et le prétraitement peuvent également vous tromper

Même si les mots générés par l'IA semblent « presque corrects », des problèmes peuvent survenir lorsque vous utilisez un outil OCR pour les vérifier. Ce n'est pas la faute de l'outil OCR, mais le prétraitement de l'image n'a pas été bien fait.

La documentation officielle de Tesseract répertorie clairement quatre éléments comme prétraitement clé pour le succès ou l'échec de l'OCR : le redimensionnement (mise à l'échelle), la binarisation (binarisation), le débruitage et le redressement (correction). PaddleOCR ajoute trois commutateurs supplémentaires : classification de direction, correction d'image de texte et classification de direction de ligne de texte.

En d’autres termes, la cause première de nombreuses « erreurs de reconnaissance OCR » n’est pas le module de reconnaissance lui-même, mais la géométrie et le prétraitement de l’image. Une image inclinée de 2 degrés, une zone de texte avec un contraste insuffisant, un morceau de texte avec un anti-aliasing trop doux - tout cela peut amener l'OCR à produire des résultats complètement faux.

Suggestions pratiques : Avant d'utiliser l'OCR pour vérifier le texte généré par l'IA, effectuez ces prétraitements : assurez-vous que le contraste dans la zone de texte est suffisant, que l'image n'est pas inclinée de manière significative et que les bords du texte ne sont pas excessivement flous. C'est beaucoup plus efficace que de passer à un modèle OCR plus grand.

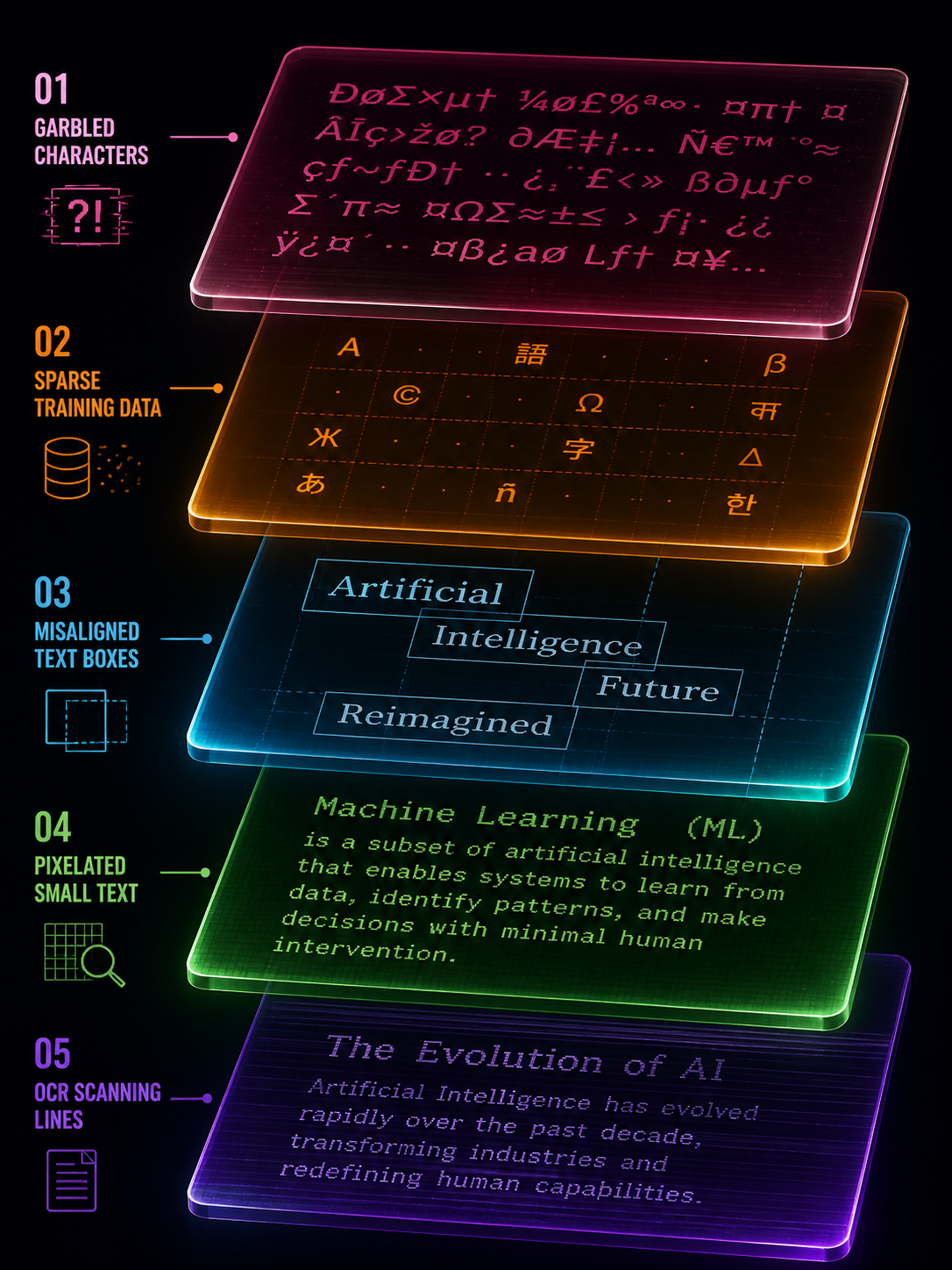

La réalité après avoir superposé cinq niveaux de causes

Empilez les cinq couches ensemble et vous comprendrez pourquoi « l'écriture IA » est si difficile :

- L'encodeur de texte du modèle n'est pas conçu pour des glyphes précis

- Manque de données de formation d'appariement glyphes-polices de haute qualité

- Faible capacité de contrôle géométrique de la mise en page multi-texte

- La compression de l'espace latent n'est pas adaptée aux détails haute fréquence des petits caractères.

- Un prétraitement incorrect de l'image entraînera des erreurs de vérification

Ces problèmes à cinq couches ne sont pas des défauts d’un certain modèle, mais des limitations structurelles de l’ensemble du paradigme de génération d’images de diffusion. GPT Image 2 est bien meilleur en termes de rendu de texte que son prédécesseur, mais ces limitations sous-jacentes n'ont pas disparu : elles n'ont été que partiellement atténuées.

"Laisser l'IA le réécrire une fois" est-il utile ?

Utile, mais limité.

Pour les termes d'affichage courts (titres de 3 à 5 mots, noms de marques), il est en effet possible de "frapper" une version correcte avec régénération. Mais il s’agit essentiellement d’un jeu de probabilité : chaque génération est un tirage indépendant et la convergence n’est pas garantie.

Pour les textes longs, les zones de texte multiples et les mises en page complexes, la régénération améliorera rarement le problème. Parce que la cause profonde n’est pas le « hasard », mais la limite supérieure structurelle des capacités du modèle. Vous réessayez 10 fois, et peut-être 10 fois vous vous trompez à différents endroits.

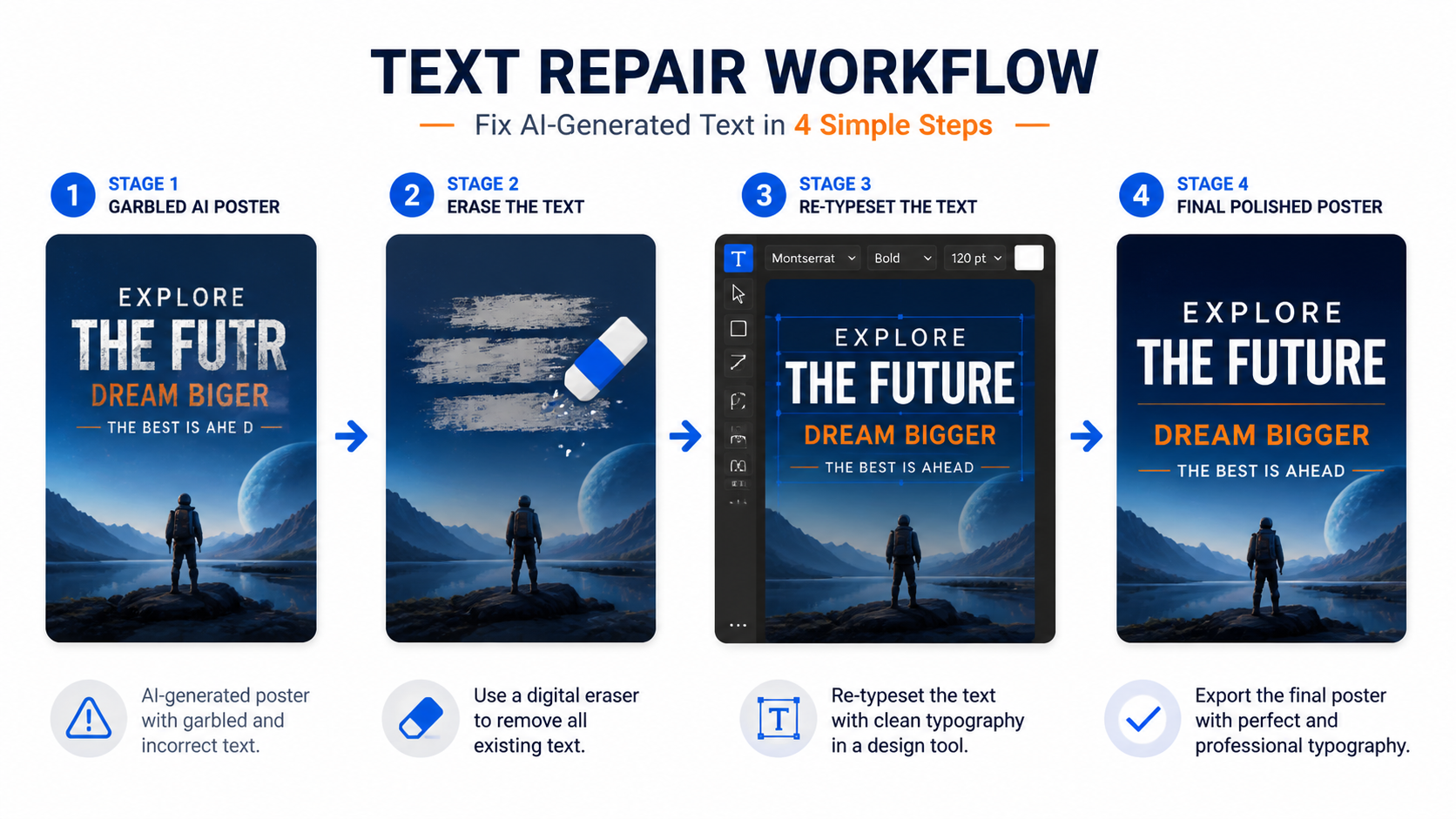

Une approche plus stable consiste à traiter le texte généré par l'IA comme un « croquis » - cela vous donne un style, une mise en page et une atmosphère approximatifs, mais le texte lui-même doit entrer dans un processus de post-traitement de « effacement - reconnaissance/relecture - réarrangement - exportation ».

Ce n'est pas "L'IA n'est pas bonne", mais "L'IA est responsable des parties pour lesquelles elle est bonne (style visuel), et les personnes et les outils sont responsables des parties pour lesquelles l'IA n'est pas bonne (texte précis)".

Niveaux de risque dans différents scénarios

Tous les textes ne nécessitent pas le même niveau de post-traitement. Selon le niveau de risque :

Faible risque : texte décoratif pour les titres d'affiches, graphiques de réseaux sociaux. Ce type de texte est plus esthétique, à condition qu'il « ait l'air bien ». L'IA directe + l'inspection visuelle sont généralement suffisantes. Vous pouvez également essayer d'utiliser Inpaint pour corriger les mots d'affichage courts.

Risque moyen : marque, nom de l'événement, date, prix. Ce type de texte nécessite « vraiment vrai », mais il n'y a pas beaucoup de mots. Il est recommandé d'utiliser la vérification OCR + la révision manuelle et d'utiliser l'édition locale pour réparer les erreurs.

Risque élevé : listes d'ingrédients, texte réglementaire, étiquettes multilingues, données infographiques. Ce type de texte a une tolérance aux erreurs extrêmement faible, et une seule erreur de lettre ou de chiffre peut entraîner des problèmes juridiques. Par défaut, il entre dans le processus « extraction OCR + réarrangement vectoriel + relecture élément par élément », et ne parie pas sur l'IA pour réussir en une seule fois.

La norme de jugement est très simple : Les titres des affiches peuvent donner l'impression qu'ils sont correctement disposés ; les étiquettes et les infographies doivent exiger "vraiment disposées correctement".

Résumé en une phrase

Les erreurs de texte générées par l'IA ne sont pas accidentelles, mais la superposition de problèmes structurels à cinq couches tels que l'encodage du texte, les données de formation, le contrôle de la mise en page, la compression de l'espace latent et le prétraitement. La stratégie la plus stable n'est pas de réessayer encore et encore, mais de traiter le texte de l'IA comme une esquisse et d'utiliser le processus de post-traitement « effacer-reconnaître-réorganiser » pour le corriger.

Vous voulez voir la vraie différence de rendu du texte entre les différents modèles ? Vous pouvez exécuter plusieurs modèles en utilisant le même mot d'invite sur gpt-image-2.live et comparer la précision du texte - vous constaterez que l'écart est plus grand que vous ne le pensez.

Articles liés

GPT Image 2 vs Nano Banana 2 : Le duel ultime de la génération d'images par IA, quel est votre meilleur choix ?

4 mai 2026

100 SKU pour seulement 8 $ : Un guide pratique de GPT Image 2 pour la photographie de produits e-commerce

3 mai 2026

![[fr] Transforming Production Workflows with GPT Image 2 Capabilities](https://gpt-image-2.live/blog-assets/f7f88ae7fe45ba37/hero-replicate.webp)

[fr] Transforming Production Workflows with GPT Image 2 Capabilities

27 avr. 2026