AI-जनरेटेड तस्वीरों में हमेशा टाइपो त्रुटियां क्यों होती हैं? कारणों की पाँच

AI 测评室

4 मई 2026

आपने पाया होगा कि एआई द्वारा खींची गई तस्वीरें बेहतर से बेहतर होती जा

आपने पाया होगा: एआई द्वारा खींची गई तस्वीरें बेहतर से बेहतर होती जा रही हैं, लेकिन तस्वीरों में शब्द अक्सर गलत होते हैं। यह कोई दुर्घटना नहीं है - यह एक संरचनात्मक समस्या है।

एक पागलपन भरा दृश्य

आप एक सुंदर प्रचार पोस्टर बनाने के लिए AI का उपयोग करते हैं। रचना उत्तम है, रंग मिलान उन्नत है, और प्रकाश और छाया प्राकृतिक हैं। फिर आप करीब से देखें - "समर सेल" को "समर साई" के रूप में लिखा गया है, या चीनी शीर्षक "लिमिटेड टाइम स्पेशल ऑफर" में "हुई" शब्द में एक क्षैतिज रेखा गायब है।

आप एक बार पुनर्जीवित हो गए। इस बार "सेल" सही है, लेकिन उपशीर्षक में तारीख अस्पष्ट हो गई है।

आप पुनः प्रयास करें. तारीख सही है, लेकिन वर्ण रिक्ति अचानक बड़ी और छोटी हो गई है, और समग्र लेआउट एक नशे जैसा दिखता है।

ऐसा इसलिए नहीं है क्योंकि आपके संकेतित शब्द अच्छी तरह से नहीं लिखे गए हैं, न ही इसका कारण यह है कि मॉडल बहुत खराब है। यह वर्तमान एआई छवि निर्माण तकनीक की एक संरचनात्मक कमी है - और यह जल्द ही दूर नहीं होने वाली है।

यह लेख समस्या का समाधान करेगा, पांच स्तरों से समझाएगा कि "शब्द हमेशा गलत क्यों लिखे जाते हैं", और फिर आपको बताएगा कि "एआई को इसे फिर से लिखने देना" आमतौर पर सबसे अच्छा समाधान क्यों नहीं है।

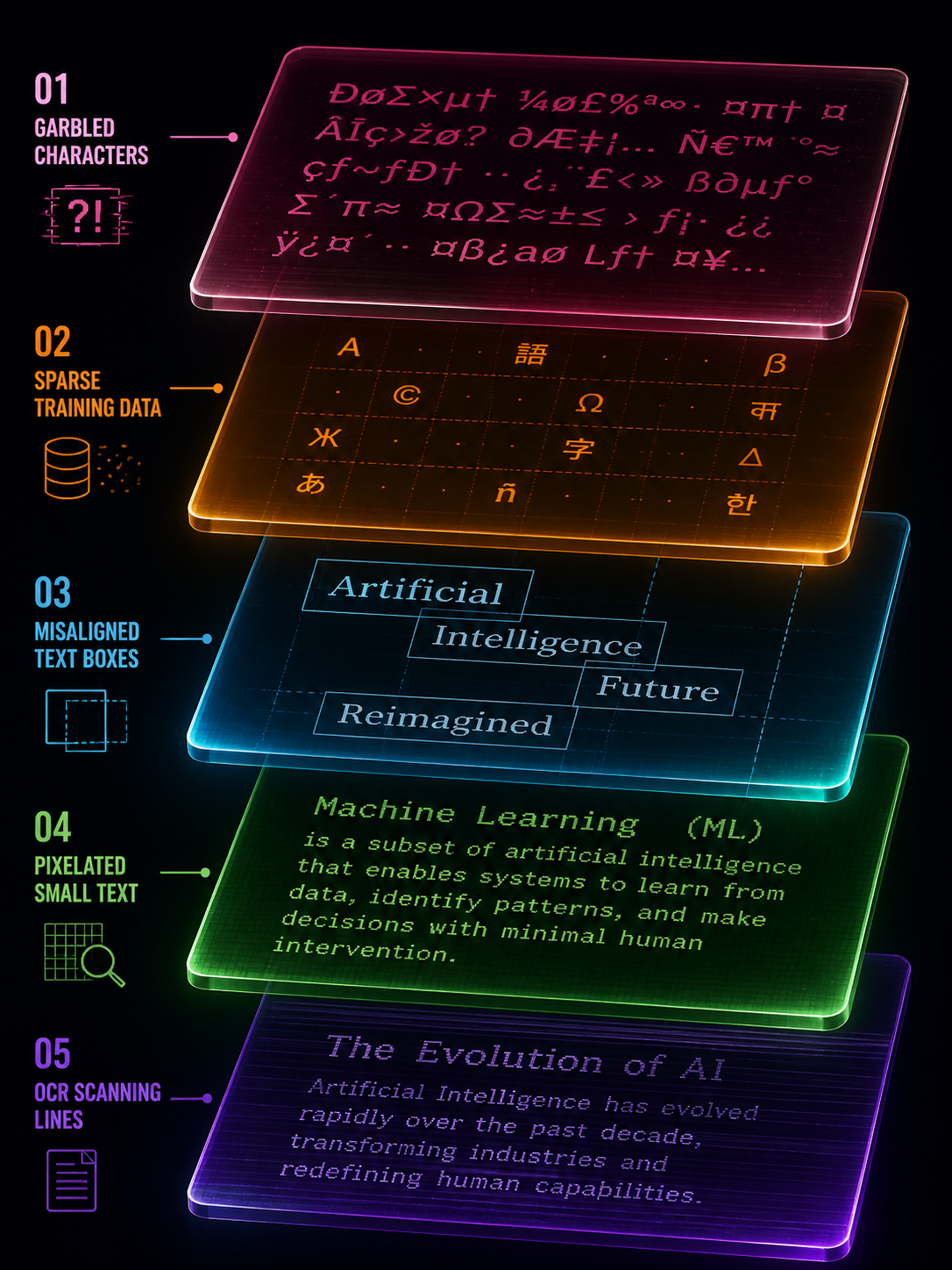

कारण का पहला स्तर: मॉडल शब्द को बिल्कुल भी "पहचान" नहीं पाता है

ज्यादातर लोग सोचते हैं कि एआई मॉडल "पहले टेक्स्ट को समझते हैं और फिर उसे बनाते हैं"। यह मसला नहीं है।

मुख्यधारा की छवि निर्माण मॉडल (स्थिर प्रसार, DALL-E, फ्लक्स, आदि) BPE शब्द विभाजन का उपयोग करते हैं - एक कोडिंग विधि जो पाठ को "शब्द टुकड़े" में काटती है। बीपीई शब्दार्थ को समझने में अच्छा है ("यह एक पोस्टर है"), लेकिन ग्लिफ़ को सटीक रूप से नियंत्रित करने में अच्छा नहीं है ("यह अक्षर ई है, एफ नहीं")।

इससे भी अधिक परेशानी की बात यह है कि इन मॉडलों में टेक्स्ट एनकोडर - चाहे सीएलआईपी हो या टी5 - "वर्णों को सटीक रूप से खींचने" के लिए डिज़ाइन नहीं किए गए हैं। सीएलआईपी "अवधारणा संरेखण" (चित्रों और पाठ के बीच पत्राचार को समझना) का समर्थन करता है, और टी5 "भाषा समझ" (वाक्यों के अर्थ को समझना) का समर्थन करता है। न ही "पिक्सेल-स्तरीय टेक्स्ट रेंडरिंग" के लिए डिज़ाइन किया गया है।

उदाहरण के लिए: एक मजबूत समझ वाले लेकिन खराब लेखन कौशल वाले व्यक्ति को अपनी आंखें बंद करके कैनवास पर पाठ के एक टुकड़े की नकल करने दें। वह मोटे तौर पर जानता है कि वह क्या लिखना चाहता है, लेकिन प्रत्येक शब्द के स्ट्रोक, रिक्ति और आकार सभी अलग-अलग होते हैं। यह टेक्स्ट प्रोसेसिंग के वर्तमान मॉडल की मूल स्थिति है।

इसका मतलब है: इससे कोई फर्क नहीं पड़ता कि आप शीघ्र शब्दों को कैसे अनुकूलित करते हैं, मॉडल के पाठ नियंत्रण की सटीकता की स्वाभाविक रूप से एक ऊपरी सीमा होती है। इस ऊपरी सीमा को "प्रॉम्प्ट वर्ड तकनीक" द्वारा पार नहीं किया जा सकता है।

कारण का दूसरा स्तर: प्रशिक्षण डेटा में "ग्लिफ़ जोड़े" की कमी

भले ही मॉडल पाठ को सटीक रूप से प्रस्तुत करने में सक्षम है, इसे सीखने के लिए बड़ी मात्रा में "टेक्स्ट-ग्लिफ़" युग्मित प्रशिक्षण डेटा की आवश्यकता होती है। समस्या यह है कि ऐसे उच्च-गुणवत्ता वाले डेटा दुर्लभ हैं।

वास्तविक दुनिया की छवियों में वास्तव में बहुत सारा पाठ है - सड़क के संकेत, पैकेजिंग, पोस्टर, किताबें - लेकिन इस पाठ का फ़ॉन्ट एनोटेशन लगभग न के बराबर है। मॉडल जानता है कि "इस चित्र में शब्द हैं", लेकिन यह नहीं जानता कि "इस शब्द के लिए किस फ़ॉन्ट, किस वज़न और किस रिक्ति का उपयोग किया गया है"।

परिणाम यह है: मॉडल "शब्दों को मोटे तौर पर चित्रित करना" सीख सकता है, लेकिन यह "फ़ॉन्ट शैली को सटीक रूप से नियंत्रित करना" नहीं सीख सकता है। यह सीधे फ़ॉन्ट शैली विचलन की ओर ले जाता है - यदि आप सैन्स-सेरिफ़ मांगते हैं, तो यह आपको एक अनुमानित सेरिफ़ देगा; यदि आप एक ही पंक्ति में समान मोटाई मांगते हैं, तो यह आपको मोटा या पतला देगा।

चीन में तो स्थिति और भी गंभीर है. आमतौर पर उपयोग किए जाने वाले हजारों चीनी अक्षर हैं, और स्ट्रोक की जटिलता लैटिन अक्षरों की तुलना में बहुत अधिक है, लेकिन प्रशिक्षण डेटा में चीनी पाठ एनोटेशन और भी दुर्लभ हैं। यह बताता है कि क्यों कई मॉडल अंग्रेजी में "ठीक" हैं लेकिन चीनी में "अक्सर गलत" हैं।

कारणों की तीसरी परत: लेआउट नियंत्रण बहुत कमज़ोर है

किसी चित्र में पाठ का एक टुकड़ा केवल "कुछ शब्द" नहीं है, इसमें स्थिति, आकार, रेखा रिक्ति, वर्ण रिक्ति, संरेखण, आधार रेखा इत्यादि जैसे ज्यामितीय संबंधों का एक समूह शामिल है। वर्तमान मॉडल का इन ज्यामितीय संबंधों पर खराब नियंत्रण है।

यह साधारण परिदृश्यों में स्पष्ट नहीं है - एक बड़ा शीर्षक, एक ब्रांड नाम, मॉडल आमतौर पर इसे संभाल सकता है। लेकिन एक बार जब यह बहु-पंक्ति पाठ, एकाधिक पाठ बॉक्स और टाइपसेटिंग के विभिन्न स्तर बन जाता है, तो समस्याएं उत्पन्न होती हैं:

- शब्द कभी दूर और कभी पास होते हैं, और पंक्ति रिक्ति असंगत होती है

- बाएँ और दाएँ ग़लत संरेखण, आधारभूत बहाव

- एकाधिक टेक्स्ट बॉक्स की सापेक्ष स्थिति गलत है

- लंबे पैराग्राफ की पिछली पंक्ति में पाठ की गुणवत्ता काफी कम हो जाती है

अकादमिक समुदाय इन्हें सामूहिक रूप से "लंबा पाठ" और "एकाधिक पाठ बॉक्स" समस्याओं के रूप में संदर्भित करता है, जो वर्तमान में मान्यता प्राप्त कठिनाइयाँ हैं। EasyText और BizGen जैसे शोध विशेष रूप से "लंबे पाठ", "एकाधिक पाठ" और "अनियमित क्षेत्रों" पर केंद्रित हैं, जो स्वयं दर्शाता है कि इन परिदृश्यों की स्थिरता हल होने से बहुत दूर है।

व्यावहारिक प्रभाव: यदि आपके चित्र को केवल एक-पंक्ति कैप्शन की आवश्यकता है, तो एआई यह काम कर सकता है। यदि आपकी छवि में पाठ के पांच या छह स्तर हैं (शीर्षक, उपशीर्षक, समय, स्थान, विक्रय बिंदु, कॉल टू एक्शन), और प्रत्येक स्तर को सटीक रूप से टाइप करने की आवश्यकता है - एआई की विफलता दर नाटकीय रूप से बढ़ जाती है।

कारण की चौथी परत: अव्यक्त स्थान संपीड़न छोटे पात्रों के लिए अनुकूल नहीं है

प्रसार मॉडल सीधे पिक्सेल स्थान में काम नहीं करता है, बल्कि इसे संपीड़ित "अव्यक्त स्थान" में उत्पन्न करता है। यह बड़ी वस्तुओं (परिदृश्य, लोग, उत्पाद) के लिए बहुत अनुकूल है - वीडियो मेमोरी की बचत, कंप्यूटिंग शक्ति की बचत, और उच्च दक्षता।

लेकिन छोटे प्रिंट के लिए, गुप्त स्थान संपीड़न का अर्थ है उच्च-आवृत्ति विवरण का नुकसान। संपीड़न और पुनर्स्थापन प्रक्रिया के दौरान पतले स्ट्रोक, कठोर किनारों और बेहद कम त्रुटि सहनशीलता वाले पाठ के प्रकट होने की संभावना होती है:

- धुंधला या टूटा हुआ स्ट्रोक

- दांतेदार किनारे

- ज़ूम इन करने के बाद "गलत विवरण" दिखाई देते हैं - स्ट्रोक जो शब्दों की तरह दिखते हैं लेकिन वास्तव में मॉडल द्वारा "कल्पना" की जाती है

यह एक सामान्य घटना की व्याख्या करता है: एआई-जनित बड़ी सुर्खियाँ अक्सर अच्छी होती हैं, लेकिन छोटे पाठ (कीमत, सामग्री, अस्वीकरण) अक्सर धुंधले या विकृत होते हैं। ऐसा नहीं है कि मॉडल छोटे अक्षरों को अच्छी तरह से लिखना "नहीं चाहता", बात यह है कि अव्यक्त स्थान का रिज़ॉल्यूशन उस सीमा को सीमित करता है जिस हद तक वह छोटे अक्षरों को अच्छी तरह से "लिख सकता" है।

समाधान का तर्क: पहले शब्दों को ठीक करें, फिर उन्हें बड़ा करें। यदि आप पहले बड़ा करते हैं और फिर अक्षरों को सही करते हैं, तो मॉडल विस्तार प्रक्रिया के दौरान अधिक गलत स्ट्रोक विवरणों को "दिमाग में भर" देगा, जिससे इसे सुधारना अधिक कठिन हो जाएगा।

कारणों की पांचवीं परत: पहचान और पूर्व-प्रसंस्करण भी आपको धोखा दे सकता है

भले ही AI द्वारा उत्पन्न शब्द "लगभग सही" दिखते हों, जब आप उन्हें सत्यापित करने के लिए OCR टूल का उपयोग करते हैं तो समस्याएँ हो सकती हैं। यह ओसीआर टूल की गलती नहीं है, लेकिन इमेज प्रीप्रोसेसिंग अच्छी तरह से नहीं की गई थी।

Tesseract आधिकारिक दस्तावेज़ीकरण स्पष्ट रूप से OCR की सफलता या विफलता के लिए प्रमुख प्रीप्रोसेसिंग के रूप में चार चीजों को सूचीबद्ध करता है: रीस्केलिंग (स्केलिंग), बाइनराइज़ेशन (बिनराइज़ेशन), डीनोइज़िंग, और डेस्क्यू (सुधार)। पैडलओसीआर तीन अतिरिक्त स्विच जोड़ता है: दिशा वर्गीकरण, टेक्स्ट छवि सुधार, और टेक्स्ट लाइन दिशा वर्गीकरण।

दूसरे शब्दों में, कई "ओसीआर मान्यता त्रुटियों" का मूल कारण स्वयं पहचानकर्ता नहीं है, बल्कि छवि की ज्यामिति और प्रीप्रोसेसिंग है। एक छवि जो 2 डिग्री तक तिरछी है, अपर्याप्त कंट्रास्ट वाला एक पाठ क्षेत्र, बहुत नरम एंटी-एलियासिंग वाला पाठ का एक टुकड़ा - ये सभी ओसीआर को पूरी तरह से गलत परिणाम देने का कारण बन सकते हैं।

व्यावहारिक सुझाव: एआई-जनरेटेड टेक्स्ट को सत्यापित करने के लिए ओसीआर का उपयोग करने से पहले, ये पूर्व-प्रक्रियाएं करें: सुनिश्चित करें कि टेक्स्ट क्षेत्र में कंट्रास्ट पर्याप्त है, छवि महत्वपूर्ण रूप से झुकी हुई नहीं है, और टेक्स्ट के किनारे अत्यधिक धुंधले नहीं हैं। यह बड़े OCR मॉडल पर स्विच करने से कहीं अधिक प्रभावी है।

कारणों की पाँच परतों को आरोपित करने के बाद वास्तविकता

पांच परतों को एक साथ रखें और आप समझ जाएंगे कि "एआई लेखन" इतना कठिन क्यों है:

- मॉडल का टेक्स्ट एनकोडर सटीक ग्लिफ़ के लिए डिज़ाइन नहीं किया गया है

- उच्च गुणवत्ता वाले ग्लिफ़-फ़ॉन्ट पेयरिंग प्रशिक्षण डेटा का अभाव

- मल्टी-टेक्स्ट लेआउट की कमजोर ज्यामितीय नियंत्रण क्षमता

- अव्यक्त स्थान संपीड़न छोटे अक्षरों के उच्च-आवृत्ति विवरण के लिए अनुकूल नहीं है।

- अनुचित छवि प्रीप्रोसेसिंग से सत्यापन में त्रुटियां होंगी

ये पाँच-परत समस्याएँ किसी निश्चित मॉडल के दोष नहीं हैं, बल्कि संपूर्ण प्रसार छवि निर्माण प्रतिमान की संरचनात्मक सीमाएँ हैं। जीपीटी इमेज 2 अपने पूर्ववर्ती की तुलना में टेक्स्ट रेंडरिंग में बहुत बेहतर है, लेकिन ये अंतर्निहित सीमाएँ गायब नहीं हुई हैं - उन्हें केवल आंशिक रूप से कम किया गया है।

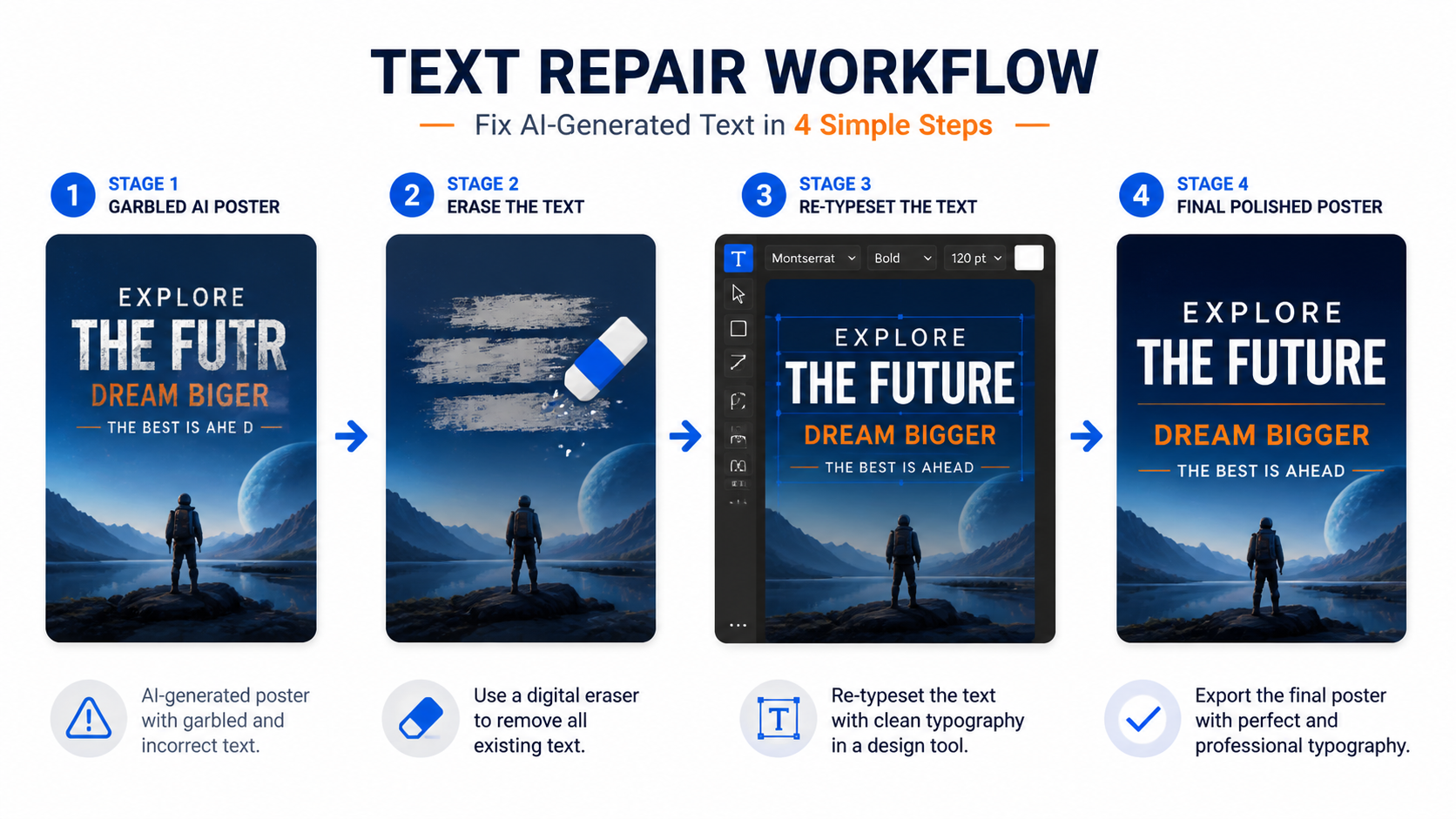

क्या "एआई को इसे एक बार फिर से लिखने दें" उपयोगी है?

उपयोगी, लेकिन सीमित.

संक्षिप्त प्रदर्शन शब्दों (3-5 शब्द शीर्षक, ब्रांड नाम) के लिए, पुनर्जनन के साथ एक सही संस्करण को "हिट" करना वास्तव में संभव है। लेकिन यह अनिवार्य रूप से संभाव्यता का खेल है - प्रत्येक पीढ़ी एक स्वतंत्र ड्रा है, और अभिसरण की गारंटी नहीं है।

लंबे टेक्स्ट, एकाधिक टेक्स्ट बॉक्स और जटिल लेआउट के लिए, पुन: उत्पन्न करने से समस्या में शायद ही कभी सुधार होगा। क्योंकि मूल कारण "यादृच्छिकता" नहीं है, बल्कि मॉडल की क्षमताओं की संरचनात्मक ऊपरी सीमा है। आप 10 बार पुनः प्रयास करते हैं, और हो सकता है कि 10 बार अलग-अलग स्थानों पर आपसे गलती हो जाए।

एआई द्वारा उत्पन्न पाठ को "स्केच" के रूप में व्यवहार करना एक अधिक स्थिर दृष्टिकोण है - यह आपको एक मोटा शैली, लेआउट और माहौल देता है, लेकिन पाठ को स्वयं "मिटाने - पहचान / प्रूफरीडिंग - पुनर्व्यवस्था - निर्यात" की पोस्ट-प्रोसेसिंग प्रक्रिया में प्रवेश करने की आवश्यकता होती है।

यह "एआई अच्छा नहीं है" नहीं है, लेकिन "एआई उन हिस्सों के लिए जिम्मेदार है जिनमें वह अच्छा है (दृश्य शैली), और लोग और उपकरण उन हिस्सों के लिए जिम्मेदार हैं जिनमें एआई अच्छा नहीं है (सटीक पाठ)"।

विभिन्न परिदृश्यों में जोखिम का स्तर

सभी पाठों को समान स्तर की पोस्ट-प्रोसेसिंग की आवश्यकता नहीं होती है। जोखिम स्तर के अनुसार:

कम जोखिम: पोस्टर शीर्षक, सोशल मीडिया ग्राफिक्स के लिए सजावटी पाठ। इस प्रकार का पाठ अधिक सौंदर्यपरक है, जब तक कि यह "सही दिखता है"। एआई सीधे + दृश्य निरीक्षण आमतौर पर पर्याप्त है। आप छोटे प्रदर्शन शब्दों को सही करने के लिए इनपेंट का उपयोग करने का भी प्रयास कर सकते हैं।

मध्यम जोखिम: ब्रांड नाम, घटना का नाम, तिथि, कीमत। इस प्रकार के पाठ के लिए "वास्तव में सही" की आवश्यकता होती है, लेकिन इसमें अधिक शब्द नहीं होते हैं। त्रुटियों को सुधारने के लिए OCR सत्यापन + मैन्युअल समीक्षा और स्थानीय संपादन का उपयोग करने की अनुशंसा की जाती है।

उच्च जोखिम: घटक सूचियाँ, नियामक पाठ, बहुभाषी लेबल, इन्फोग्राफिक डेटा। इस प्रकार के पाठ में त्रुटि सहनशीलता बेहद कम होती है, और एक अक्षर या संख्या की त्रुटि कानूनी समस्याओं का कारण बन सकती है। डिफ़ॉल्ट रूप से, यह "ओसीआर निष्कर्षण + वेक्टर पुनर्व्यवस्था + आइटम-दर-आइटम प्रूफरीडिंग" प्रक्रिया में प्रवेश करता है, और एआई पर एक बार में इसे सही करने पर दांव नहीं लगाता है।

निर्णय मानक बहुत सरल है: पोस्टर शीर्षकों को "ऐसा दिखने की अनुमति दी जा सकती है जैसे वे सही ढंग से व्यवस्थित हैं"; लेबल और इन्फोग्राफिक्स को "वास्तव में सही ढंग से व्यवस्थित" होना चाहिए।

एक वाक्य का सारांश

एआई द्वारा उत्पन्न पाठ में त्रुटियां आकस्मिक नहीं हैं, बल्कि पाठ एन्कोडिंग, प्रशिक्षण डेटा, लेआउट नियंत्रण, अव्यक्त स्थान संपीड़न और प्रीप्रोसेसिंग जैसे पांच-परत संरचनात्मक मुद्दों का सुपरपोजिशन है। सबसे स्थिर रणनीति बार-बार पुनः प्रयास करना नहीं है, बल्कि एआई टेक्स्ट को एक स्केच के रूप में मानना है और इसे सही करने के लिए "मिटाना-पहचानना-पुनर्व्यवस्थित करना" की पोस्ट-प्रोसेसिंग प्रक्रिया का उपयोग करना है।

विभिन्न मॉडलों के बीच पाठ प्रतिपादन में वास्तविक अंतर देखना चाहते हैं? आप gpt-image-2.live पर एक ही संकेत शब्द का उपयोग करके कई मॉडल चला सकते हैं और पाठ सटीकता की तुलना कर सकते हैं - आप पाएंगे कि अंतर आपके विचार से कहीं अधिक बड़ा है।