Perché le immagini generate dall'intelligenza artificiale contengono sempre

AI 测评室

4 maggio 2026

Potresti aver scoperto che le immagini disegnate dall''intelligenza artificiale stanno migliorando sempre di più, ma le parole nelle immagini sono spesso sbagliate. Questo non è un incidente: è un problema strutturale.

Potresti averlo scoperto: le immagini disegnate dall'intelligenza artificiale stanno migliorando sempre di più, ma le parole nelle immagini sono spesso sbagliate. Questo non è un incidente: è un problema strutturale.

Una scena pazzesca

Utilizzi l'intelligenza artificiale per generare un bellissimo poster promozionale. La composizione è perfetta, la corrispondenza dei colori è avanzata e la luce e l'ombra sono naturali. Poi dai un'occhiata più da vicino: "SALDI ESTIVI" è scritto come "SUMMER SAIE", oppure alla parola "Hui" nel titolo cinese "Offerta speciale a tempo limitato" manca una linea orizzontale.

Ti sei rigenerato una volta. Questa volta "SALDI" è corretto, ma la data nel sottotitolo è diventata confusa.

Riprova. La data è corretta, ma la spaziatura dei caratteri diventa improvvisamente grande e piccola e il layout generale sembra un ubriaco.

Questo non è perché le tue parole tempestive non siano scritte bene, né perché il modello sia pessimo. Si tratta di un difetto strutturale dell’attuale tecnologia di generazione di immagini AI e non scomparirà presto.

Questo articolo analizzerà il problema, spiegherà "perché le parole sono sempre scritte in modo errato" in cinque livelli e poi ti spiegherà perché "lasciare che l'IA lo riscriva" di solito non è la soluzione migliore.

Il primo livello di causa: il modello non "riconosce" affatto la parola

La maggior parte delle persone pensa che i modelli di intelligenza artificiale "capiscono prima il testo e poi lo disegnano". Non è questo il caso.

I modelli tradizionali di generazione di immagini (Diffusione stabile, DALL-E, Flux, ecc.) utilizzano la segmentazione delle parole BPE, un metodo di codifica che taglia il testo in "frammenti di parole". BPE è bravo a comprendere la semantica ("Questo è un poster"), ma non è bravo a controllare con precisione i glifi ("Questa lettera è una E, non una F").

Ciò che è ancora più problematico è che i codificatori di testo in questi modelli, siano essi CLIP o T5, non sono progettati per “disegnare i caratteri in modo accurato”. Il CLIP favorisce l'"allineamento dei concetti" (comprendere la corrispondenza tra immagini e testo), mentre il T5 favorisce la "comprensione del linguaggio" (comprendere il significato delle frasi). Nessuno dei due è progettato per il "rendering del testo a livello di pixel".

Ad esempio: lascia che una persona con una forte comprensione ma scarse capacità di scrittura copi un pezzo di testo su una tela con gli occhi chiusi. Sa approssimativamente cosa vuole scrivere, ma i tratti, la spaziatura e la dimensione di ogni parola sono tutti diversi. Questo è lo stato di base del modello attuale per l'elaborazione del testo.

Ciò significa: Indipendentemente da come ottimizzi le parole del prompt, la precisione del controllo del testo del modello ha naturalmente un limite superiore. Questo limite superiore non può essere superato con la "tecnica della parola suggerita".

Il secondo livello di causa: la mancanza di "coppie di glifi" nei dati di addestramento

Anche se il modello è in grado di eseguire il rendering accurato del testo, per l'apprendimento richiede una grande quantità di dati di addestramento accoppiati "testo-glifo". Il problema è che dati di così alta qualità sono scarsi.

C’è davvero molto testo nelle immagini del mondo reale – segnali stradali, imballaggi, poster, libri – ma l’annotazione dei caratteri di questo testo è quasi inesistente. Il modello sa che "ci sono parole in questa immagine", ma non sa "quale carattere, quale peso e quale spaziatura viene utilizzata per questa parola".

Il risultato è: il modello può imparare a "disegnare approssimativamente le parole", ma non può imparare a "controllare con precisione lo stile del carattere". Ciò porta direttamente alla deriva dello stile del carattere: se chiedi sans-serif, ti darà un serif approssimativo; se chiedi lo stesso spessore sulla stessa linea, ti darà uno più spesso o più sottile.

La situazione in Cina è ancora più grave. Esistono migliaia di caratteri cinesi comunemente usati e la complessità del tratto è molto superiore a quella delle lettere latine, ma le annotazioni di testo cinese nei dati di addestramento sono ancora più scarse. Questo spiega perché molti modelli sono "ok" in inglese ma "spesso sbagliati" in cinese.

Il terzo livello di cause: il controllo del layout è troppo debole

Un pezzo di testo in un'immagine non è solo "poche parole", ma coinvolge una serie di relazioni geometriche come posizione, dimensione, interlinea, spaziatura dei caratteri, allineamento, linea di base, ecc. I modelli attuali hanno scarso controllo su queste relazioni geometriche.

Ciò non è ovvio in scenari semplici: un titolo importante, un marchio, il modello di solito è in grado di gestirlo. Ma quando si tratta di testo su più righe, caselle di testo multiple e diversi livelli di composizione, sorgono problemi:

- Le parole a volte sono lontane, a volte vicine e l'interlinea è incoerente

- Disallineamento sinistro e destro, deriva della linea di base

- La posizione relativa di più caselle di testo è errata

- La qualità del testo nell'ultima riga dei paragrafi lunghi è notevolmente ridotta

La comunità accademica si riferisce a questi problemi collettivamente come problemi di "testo lungo" e "caselle di testo multiple", che sono difficoltà attualmente riconosciute. Ricerche come EasyText e BizGen si concentrano specificamente su "testo lungo", "testo multiplo" e "aree irregolari", il che dimostra di per sé che la stabilità di questi scenari è lungi dall'essere risolta.

Impatto pratico: se la tua figura necessita solo di una didascalia di una riga, l'intelligenza artificiale può fare il lavoro. Se la tua immagine ha cinque o sei livelli di testo (titolo, sottotitolo, ora, luogo, punto di vendita, invito all'azione) e ogni livello deve essere digitato con precisione, il tasso di fallimento dell'intelligenza artificiale aumenta notevolmente.

Il quarto livello di causa: la compressione dello spazio latente non è adatta ai caratteri piccoli

Il modello di diffusione non funziona direttamente nello spazio dei pixel, ma lo genera in uno "spazio latente" compresso. Questo è molto amichevole per oggetti di grandi dimensioni (paesaggi, persone, prodotti): risparmio di memoria video, risparmio di potenza di calcolo e alta efficienza.

Ma per i caratteri piccoli, la compressione dello spazio latente significa la perdita di dettagli ad alta frequenza. Durante il processo di compressione e ripristino è probabile che venga visualizzato testo con tratti sottili, bordi netti e tolleranza agli errori estremamente bassa:

- Tratti sfocati o spezzati

- bordi frastagliati

- Dopo aver ingrandito compaiono "falsi dettagli" - tratti che sembrano parole ma in realtà sono "immaginati" dal modello

Ciò spiega un fenomeno comune: i titoli grandi generati dall’intelligenza artificiale sono spesso buoni, ma i testi piccoli (prezzo, ingredienti, disclaimer) sono spesso sfocati o distorti. Non è che il modello "non voglia" scrivere bene i caratteri piccoli, è che la risoluzione dello spazio latente limita la misura in cui "può" scrivere bene i caratteri piccoli.

Logica della soluzione: Correggi prima le parole, poi ingrandile. Se prima ingrandisci e poi correggi i caratteri, il modello "riempirà" i dettagli del tratto più errati durante il processo di ingrandimento, rendendolo più difficile da riparare.

Anche il quinto livello di cause: identificazione e preelaborazione possono ingannarti

Anche se le parole generate dall'intelligenza artificiale sembrano "quasi corrette", potrebbero verificarsi problemi quando si utilizza uno strumento OCR per verificarle. Non è colpa dello strumento OCR, ma la preelaborazione dell'immagine non è stata eseguita correttamente.

La documentazione ufficiale di Tesseract elenca chiaramente quattro cose come preelaborazione chiave per il successo o il fallimento dell'OCR: rescaling (ridimensionamento), binarizzazione (binarizzazione), denoising e raddrizzamento (correzione). PaddleOCR aggiunge tre opzioni aggiuntive: classificazione della direzione, correzione dell'immagine del testo e classificazione della direzione della riga di testo.

In altre parole, la causa principale di molti "errori di riconoscimento OCR" non è il riconoscitore stesso, ma la geometria e la preelaborazione dell'immagine. Un'immagine inclinata di 2 gradi, un'area di testo con contrasto insufficiente, una porzione di testo con un anti-aliasing troppo debole: tutto può far sì che l'OCR produca risultati completamente errati.

Suggerimenti pratici: Prima di utilizzare l'OCR per verificare il testo generato dall'intelligenza artificiale, esegui queste pre-elaborazioni: assicurati che il contrasto nell'area del testo sia sufficiente, che l'immagine non sia inclinata in modo significativo e che i bordi del testo non siano eccessivamente sfocati. Questo è molto più efficace rispetto al passaggio a un modello OCR più grande.

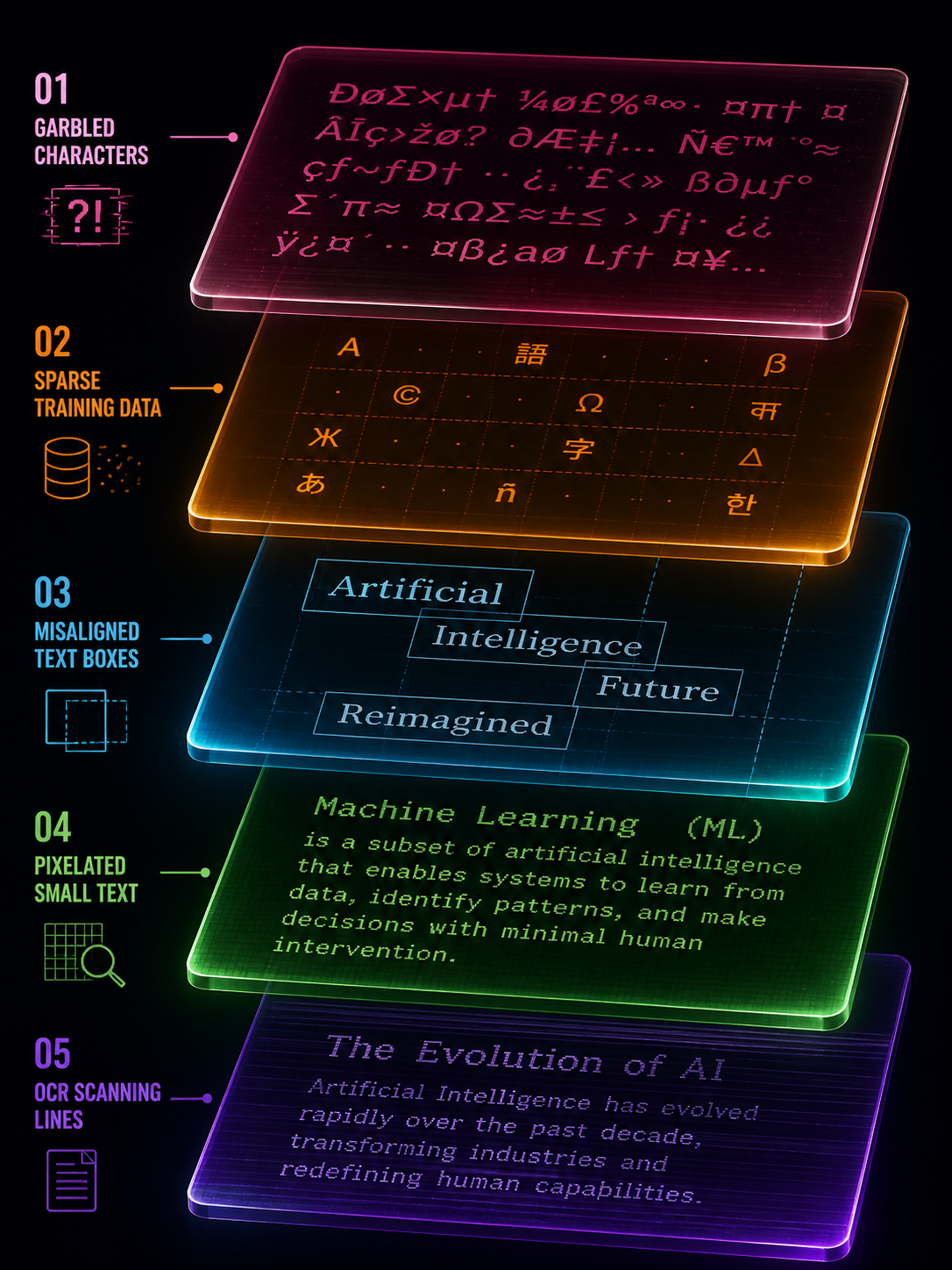

La realtà dopo aver sovrapposto cinque strati di cause

Impila insieme i cinque strati e capirai perché la "scrittura AI" è così difficile:

- Il codificatore di testo del modello non è progettato per glifi precisi

- Mancanza di dati di addestramento sull'abbinamento glifo-carattere di alta qualità

- Debole capacità di controllo geometrico del layout multi-testo

- La compressione dello spazio latente non è favorevole ai dettagli ad alta frequenza di piccoli caratteri.

- Una preelaborazione impropria delle immagini porterà a errori nella verifica

Questi problemi a cinque strati non sono difetti di un certo modello, ma limitazioni strutturali dell’intero paradigma di generazione dell’immagine di diffusione. GPT Image 2 è molto migliore nel rendering del testo rispetto al suo predecessore, ma queste limitazioni di fondo non sono scomparse: sono state alleviate solo parzialmente.

È utile "lascia che l'IA lo riscriva una volta"?

Utile, ma limitato.

Per termini di visualizzazione brevi (titoli di 3-5 parole, nomi di marchi), è infatti possibile "centrare" una versione corretta con la rigenerazione. Ma questo è essenzialmente un gioco di probabilità: ogni generazione è un’estrazione indipendente e la convergenza non è garantita.

Per testi lunghi, caselle di testo multiple e layout complessi, la rigenerazione raramente migliorerà il problema. Perché la causa principale non è la “casualità”, ma il limite strutturale superiore delle capacità del modello. Ci riprovi 10 volte e forse 10 volte sbagli in posti diversi.

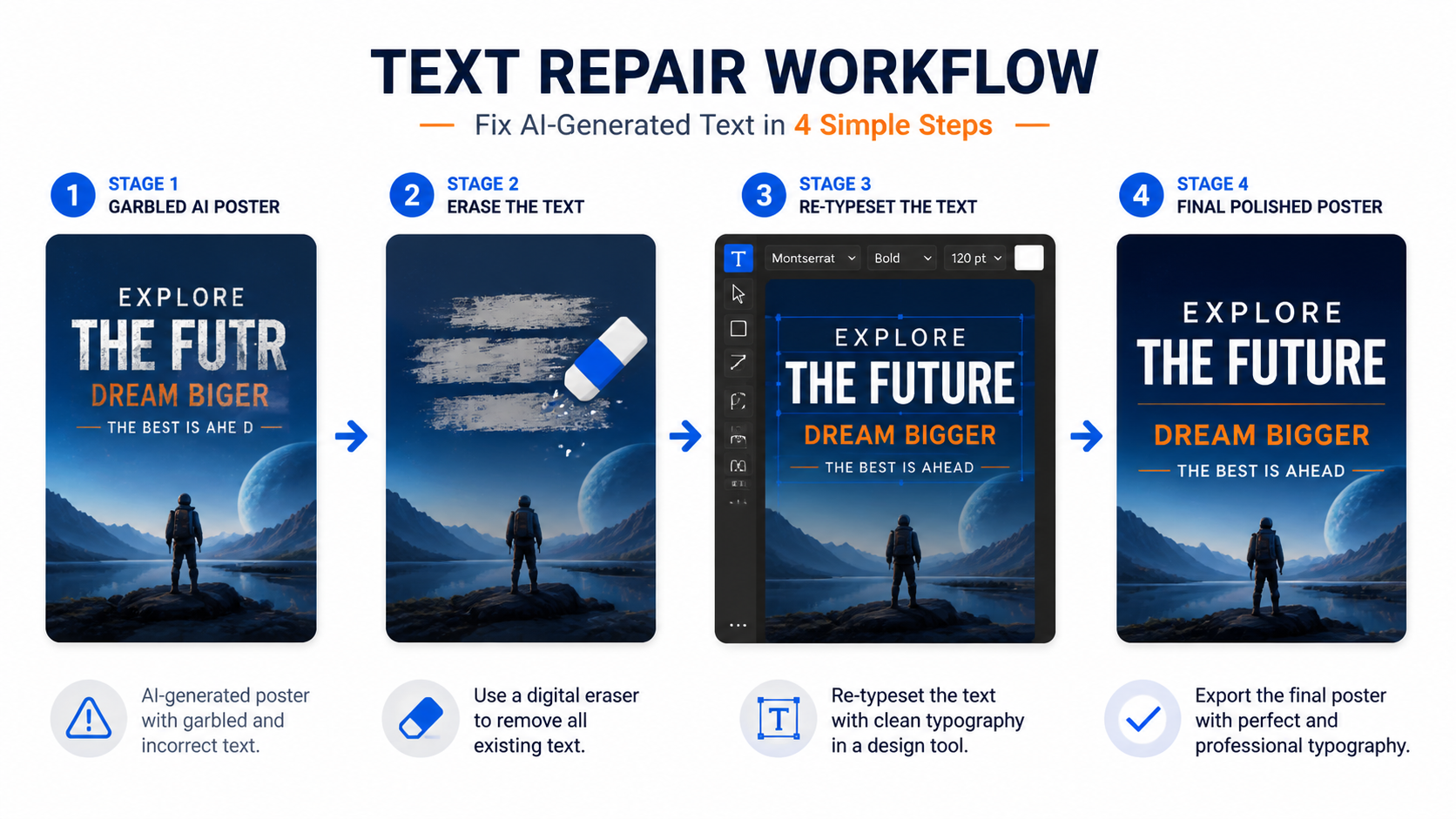

Un approccio più stabile consiste nel trattare il testo generato dall'intelligenza artificiale come uno "schizzo": fornisce uno stile, un layout e un'atmosfera approssimativi, ma il testo stesso deve essere sottoposto a un processo di post-elaborazione di "cancellazione - riconoscimento/correzione di bozze - riorganizzazione - esportazione".

Questo non è "L'intelligenza artificiale non è buona", ma "L'intelligenza artificiale è responsabile delle parti in cui è brava (stile visivo) e le persone e gli strumenti sono responsabili delle parti in cui l'intelligenza artificiale non è brava (testo preciso)".

Livelli di rischio in diversi scenari

Non tutto il testo richiede lo stesso livello di post-elaborazione. Secondo il livello di rischio:

Basso rischio: testo decorativo per titoli di poster, grafica per social media. Questo tipo di testo è più estetico, purché "sembra giusto". L'intelligenza artificiale diretta + l'ispezione visiva sono generalmente sufficienti. Puoi anche provare a utilizzare inpaint per correggere le parole visualizzate brevi.

Rischio medio: nome del marchio, nome dell'evento, data, prezzo. Questo tipo di testo richiede "davvero giusto", ma non ci sono molte parole. Si consiglia di utilizzare la verifica OCR + revisione manuale e utilizzare la modifica locale per correggere gli errori.

Alto rischio: elenchi ingredienti, testo normativo, etichette multilingue, dati infografici. Questo tipo di testo ha una tolleranza agli errori estremamente bassa e un errore di una sola lettera o numero può portare a problemi legali. Per impostazione predefinita, entra nel processo di "estrazione OCR + riorganizzazione vettoriale + correzione di bozze articolo per articolo" e non scommette sul fatto che l'intelligenza artificiale riesca a farlo bene in una volta sola.

Lo standard di giudizio è molto semplice: i titoli dei poster possono "sembrare disposti correttamente"; le etichette e le infografiche devono richiedere "organizzate davvero correttamente".

Riepilogo di una frase

Gli errori nel testo generati dall'intelligenza artificiale non sono casuali, ma sono la sovrapposizione di problemi strutturali a cinque livelli come la codifica del testo, i dati di addestramento, il controllo del layout, la compressione dello spazio latente e la preelaborazione. La strategia più stabile è non riprovare ancora e ancora, ma trattare il testo AI come uno schizzo e utilizzare il processo di post-elaborazione di "cancella-riconosci-riarrangia" per correggerlo.

Vuoi vedere la reale differenza nel rendering del testo tra diversi modelli? Puoi eseguire diversi modelli utilizzando la stessa parola di richiesta su gpt-image-2.live e confrontare la precisione del testo: scoprirai che il divario è maggiore di quanto pensi.

![[it] Transforming Production Workflows with GPT Image 2 Capabilities](https://gpt-image-2.live/blog-assets/f7f88ae7fe45ba37/hero-replicate.webp)