Por que as imagens geradas por IA sempre contêm erros de digitação? Desmonte

AI 测评室

4 de maio de 2026

Você pode ter descoberto que as imagens desenhadas pela IA estão cada

Você pode ter descoberto: as imagens desenhadas pela IA estão cada vez melhores, mas as palavras nas imagens geralmente estão erradas. Isto não é um acidente – é um problema estrutural.

Uma cena maluca

Você usa IA para gerar um lindo pôster promocional. A composição é perfeita, a combinação de cores é avançada e a luz e a sombra são naturais. Então você olha mais de perto - "PROMOÇÃO DE VERÃO" está escrito como "SAIE DE VERÃO" ou a palavra "Hui" no título chinês "Oferta especial por tempo limitado" está faltando uma linha horizontal.

Você se regenerou uma vez. Desta vez, “VENDA” está correto, mas a data na legenda ficou distorcida.

Você tenta novamente. A data está correta, mas o espaçamento entre caracteres de repente é grande e pequeno, e o layout geral parece um bêbado.

Isso não ocorre porque suas palavras de estímulo não estejam bem escritas, nem porque o modelo seja muito ruim. Esta é uma deficiência estrutural da atual tecnologia de geração de imagens de IA – e não irá desaparecer tão cedo.

Este artigo analisará o problema, explicará "por que as palavras são sempre escritas incorretamente" em cinco níveis e, em seguida, explicará por que "deixar a IA reescrever" geralmente não é a melhor solução.

O primeiro nível de causa: o modelo não "reconhece" a palavra

A maioria das pessoas pensa que os modelos de IA “primeiro entendem o texto e depois desenham-no”. Este não é o caso.

Os principais modelos de geração de imagens (Stable Diffusion, DALL-E, Flux, etc.) usam segmentação de palavras BPE - um método de codificação que corta o texto em "fragmentos de palavras". O BPE é bom em entender a semântica ("Isto é um pôster"), mas não é bom em controlar glifos com precisão ("Esta letra é um E, não um F").

O que é ainda mais problemático é que os codificadores de texto nesses modelos – seja CLIP ou T5 – não são projetados para “desenhar caracteres com precisão”. O CLIP favorece o “alinhamento de conceitos” (compreensão da correspondência entre imagens e texto), e o T5 favorece a “compreensão da linguagem” (compreensão do significado das frases). Nenhum dos dois foi projetado para "renderização de texto em nível de pixel".

Por exemplo: deixe uma pessoa com forte compreensão, mas com poucas habilidades de escrita, copiar um trecho de texto em uma tela com os olhos fechados. Ele sabe aproximadamente o que quer escrever, mas os traços, o espaçamento e o tamanho de cada palavra são diferentes. Este é o estado básico do modelo atual para processamento de texto.

Isso significa: Não importa como você otimiza as palavras de prompt, a precisão do controle de texto do modelo naturalmente tem um limite superior. Este limite superior não pode ser excedido pela "técnica da palavra imediata".

O segundo nível de causa: a falta de "pares de glifos" nos dados de treinamento

Mesmo que o modelo seja capaz de renderizar texto com precisão, ele requer uma grande quantidade de dados de treinamento emparelhados "texto-glifo" para aprender. O problema é que esses dados de alta qualidade são escassos.

Na verdade, há muito texto em imagens do mundo real – placas de rua, embalagens, cartazes, livros – mas a anotação da fonte deste texto é quase inexistente. A modelo sabe “há palavras nesta imagem”, mas não sabe “qual fonte, qual peso e qual espaçamento é usado para esta palavra”.

O resultado é: o modelo pode aprender a “desenhar as palavras aproximadamente”, mas não pode aprender a “controlar com precisão o estilo da fonte”. Isso leva diretamente ao desvio do estilo da fonte - se você solicitar sem serifa, obterá uma serifa aproximada; se você pedir a mesma espessura na mesma linha, você terá uma mais grossa ou mais fina.

A situação na China é ainda mais grave. Existem milhares de caracteres chineses comumente usados, e a complexidade do traço é muito maior do que a das letras latinas, mas as anotações de texto chinês nos dados de treinamento são ainda mais escassas. Isto explica por que muitos modelos são “ok” em inglês, mas “frequentemente errados” em chinês.

A terceira camada de causas: o controle de layout é muito fraco

Um pedaço de texto em uma imagem não é apenas “algumas palavras”, mas envolve um monte de relações geométricas, como posição, tamanho, espaçamento entre linhas, espaçamento entre caracteres, alinhamento, linha de base, etc.

Isso não é óbvio em cenários simples – um grande título, um nome de marca, o modelo geralmente consegue lidar com isso. Mas quando se torna texto com várias linhas, múltiplas caixas de texto e diferentes níveis de composição tipográfica, surgem problemas:

- As palavras às vezes estão distantes e às vezes próximas, e o espaçamento entre linhas é inconsistente

- Desalinhamento esquerdo e direito, desvio da linha de base

- A posição relativa de múltiplas caixas de texto está errada

- A qualidade do texto na última linha de parágrafos longos é significativamente reduzida

A comunidade acadêmica refere-se a estes problemas coletivamente como problemas de “texto longo” e “caixas de texto múltiplas”, que atualmente são dificuldades reconhecidas. Pesquisas como EasyText e BizGen concentram-se especificamente em “texto longo”, “texto múltiplo” e “áreas irregulares”, o que por si só mostra que a estabilidade destes cenários está longe de ser resolvida.

Impacto prático: Se sua figura precisar apenas de uma legenda de uma linha, a IA pode fazer o trabalho. Se sua imagem tiver cinco ou seis níveis de texto (título, subtítulo, hora, local, argumento de venda, apelo à ação) e cada nível precisar ser digitado com precisão, a taxa de falha da IA aumenta dramaticamente.

A quarta camada de causa: a compactação de espaço latente não é amigável para caracteres pequenos

O modelo de difusão não funciona diretamente no espaço de pixels, mas o gera em um “espaço latente” compactado. Isto é muito amigável para objetos grandes (paisagens, pessoas, produtos) - economizando memória de vídeo, economizando poder de computação e alta eficiência.

Mas para letras pequenas, a compressão do espaço latente significa a perda de detalhes de alta frequência. Texto com traços finos, bordas rígidas e tolerância a erros extremamente baixa tende a aparecer durante o processo de compactação e restauração:

- Traços borrados ou quebrados

- bordas irregulares

- "Detalhes falsos" aparecem após o zoom - traços que parecem palavras, mas na verdade são "imaginados" pelo modelo

Isso explica um fenômeno comum: manchetes grandes geradas por IA costumam ser boas, mas textos pequenos (preço, ingredientes, isenções de responsabilidade) costumam ficar borrados ou distorcidos. Não é que o modelo “não queira” escrever bem caracteres pequenos, é que a resolução do espaço latente limita até que ponto ele “pode” escrever bem caracteres pequenos.

Lógica da solução: Corrija primeiro as palavras e depois amplie-as. Se você ampliar primeiro e depois corrigir os caracteres, o modelo “preencherá” mais detalhes errôneos do traço durante o processo de ampliação, dificultando o reparo.

A quinta camada de causas: identificação e pré-processamento também podem enganar você

Mesmo que as palavras geradas pela IA pareçam “quase corretas”, pode haver problemas ao usar uma ferramenta de OCR para verificá-las. Isso não é culpa da ferramenta OCR, mas o pré-processamento da imagem não foi bem feito.

A documentação oficial do Tesseract lista claramente quatro coisas como pré-processamento chave para o sucesso ou fracasso do OCR: redimensionamento (escalonamento), binarização (binarização), remoção de ruído e enquadramento (correção). PaddleOCR adiciona três opções adicionais: classificação de direção, correção de imagem de texto e classificação de direção de linha de texto.

Em outras palavras, a causa raiz de muitos “erros de reconhecimento de OCR” não é o reconhecedor em si, mas a geometria e o pré-processamento da imagem. Uma imagem distorcida em 2 graus, uma área de texto com contraste insuficiente, um pedaço de texto com suavização de serrilhado muito suave - tudo isso pode fazer com que o OCR produza resultados completamente errados.

Sugestões práticas: Antes de usar o OCR para verificar texto gerado por IA, faça estes pré-processamentos: certifique-se de que o contraste na área de texto seja suficiente, que a imagem não esteja significativamente inclinada e que as bordas do texto não estejam excessivamente desfocadas. Isto é muito mais eficaz do que mudar para um modelo de OCR maior.

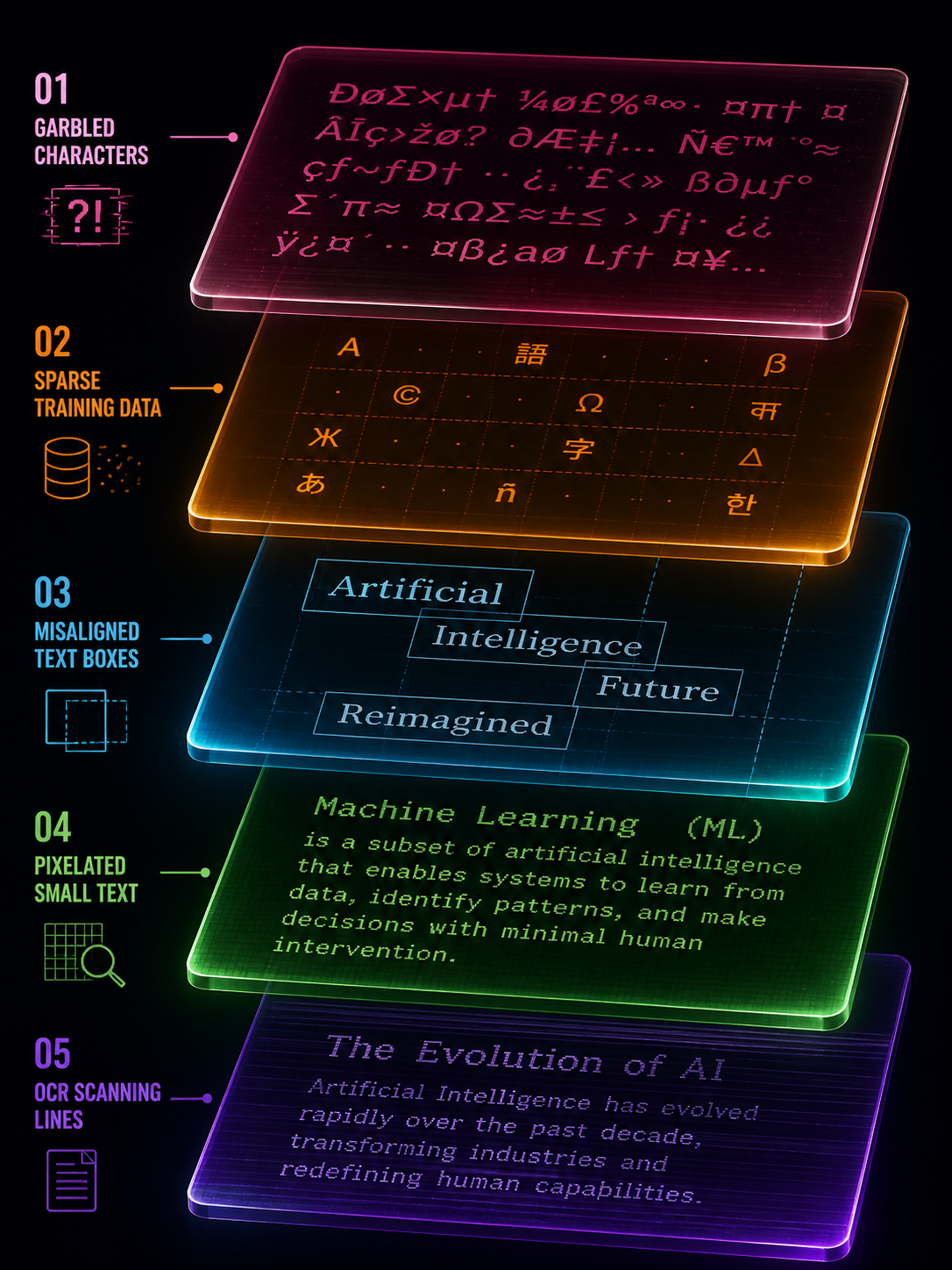

A realidade depois de sobrepor cinco camadas de causas

Empilhe as cinco camadas e você entenderá por que “escrever IA” é tão difícil:

- O codificador de texto do modelo não foi projetado para glifos precisos

- Falta de dados de treinamento de emparelhamento de fonte de glifo de alta qualidade

- Fraca capacidade de controle geométrico do layout multitexto

- A compactação de espaço latente não é compatível com detalhes de alta frequência de caracteres pequenos.

- O pré-processamento inadequado da imagem levará a erros na verificação

Esses problemas de cinco camadas não são defeitos de um determinado modelo, mas limitações estruturais de todo o paradigma de geração de imagens por difusão. GPT Image 2 é muito melhor na renderização de texto do que seu antecessor, mas essas limitações subjacentes não desapareceram – elas foram apenas parcialmente aliviadas.

"Deixar a IA reescrever uma vez" é útil?

Útil, mas limitado.

Para termos de exibição curtos (títulos de 3 a 5 palavras, nomes de marcas), é realmente possível "acertar" uma versão correta com regeneração. Mas isto é essencialmente um jogo de probabilidade – cada geração é um sorteio independente e a convergência não é garantida.

Para textos longos, múltiplas caixas de texto e layouts complexos, a regeneração raramente resolverá o problema. Porque a causa raiz não é a "aleatoriedade", mas o limite superior estrutural das capacidades do modelo. Você tenta novamente 10 vezes e talvez 10 vezes erra em lugares diferentes.

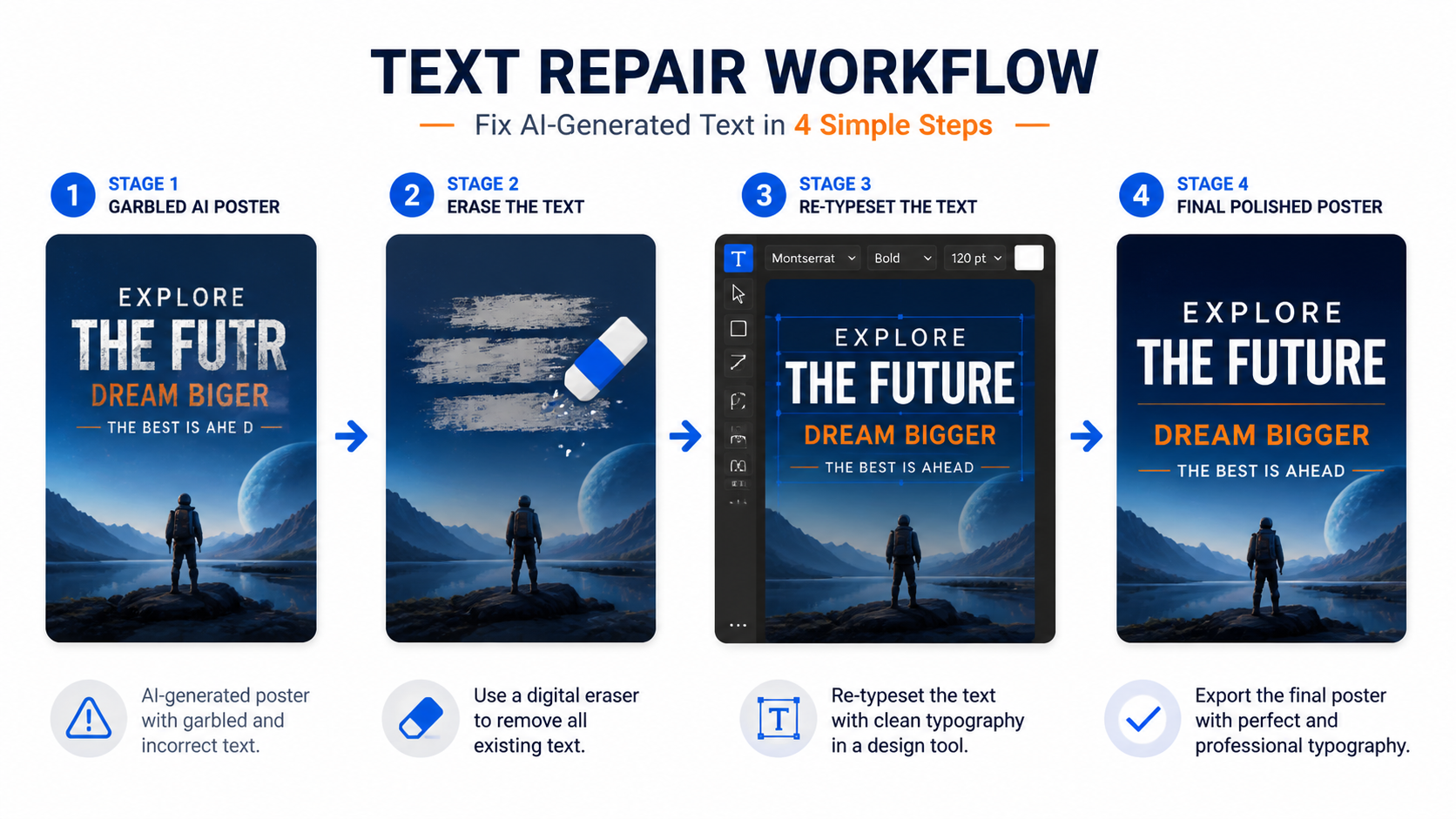

Uma abordagem mais estável é tratar o texto gerado pela IA como um "esboço" - isso lhe dá um estilo, layout e atmosfera aproximados, mas o texto em si precisa entrar em um processo de pós-processamento de "apagamento - reconhecimento/revisão - reorganização - exportação".

Isso não é “IA não é boa”, mas “IA é responsável pelas partes em que é boa (estilo visual), e pessoas e ferramentas são responsáveis pelas partes em que a IA não é boa (texto preciso)”.

Níveis de risco em diferentes cenários

Nem todo texto requer o mesmo nível de pós-processamento. De acordo com o nível de risco:

Baixo risco: Texto decorativo para títulos de pôsteres, gráficos de mídias sociais. Esse tipo de texto é mais estético, desde que “pareça certo”. IA direta + inspeção visual geralmente são suficientes. Você também pode tentar usar o inpaint para corrigir palavras curtas exibidas.

Risco médio: marca, nome do evento, data, preço. Esse tipo de texto exige “realmente certo”, mas não há muitas palavras. Recomenda-se usar verificação OCR + revisão manual e usar edição local para reparar erros.

Alto risco: listas de ingredientes, texto regulamentar, rótulos multilíngues, dados infográficos. Este tipo de texto tem tolerância a erros extremamente baixa, e um único erro de letra ou número pode levar a problemas legais. Por padrão, ele entra no processo de “extração de OCR + reorganização vetorial + revisão item por item” e não aposta que a IA acertará de uma só vez.

O padrão de julgamento é muito simples: Os títulos dos pôsteres podem “parecer que estão organizados corretamente”; rótulos e infográficos devem exigir “realmente organizados corretamente”.

Resumo de uma frase

Os erros no texto gerados pela IA não são acidentais, mas sim a sobreposição de questões estruturais de cinco camadas, como codificação de texto, dados de treinamento, controle de layout, compressão de espaço latente e pré-processamento. A estratégia mais estável não é tentar novamente, mas tratar o texto da IA como um esboço e usar o processo de pós-processamento de "apagar-reconhecer-reorganizar" para corrigi-lo.

Quer ver a real diferença na renderização de texto entre diferentes modelos? Você pode executar vários modelos usando a mesma palavra de prompt em gpt-image-2.live e comparar a precisão do texto - você descobrirá que a lacuna é maior do que você pensa.

Artigos relacionados

GPT Image 2 vs Nano Banana 2: O Duelo Definitivo de Geração de Imagens por IA, Qual é a Sua Melhor Opção?

4 de mai. de 2026

$8 por 100 SKUs: Um Guia Prático do GPT Image 2 para Fotografia de Produtos de E-commerce

3 de mai. de 2026

![[pt] Transforming Production Workflows with GPT Image 2 Capabilities](https://gpt-image-2.live/blog-assets/f7f88ae7fe45ba37/hero-replicate.webp)

[pt] Transforming Production Workflows with GPT Image 2 Capabilities

27 de abr. de 2026