Почему изображения, созданные ИИ, всегда содержат опечатки? Разберите модель,

AI 测评室

4 мая 2026 г.

Возможно, вы заметили, что картинки, нарисованные ИИ, становятся все

Возможно, вы обнаружили: картинки, нарисованные ИИ, становятся все лучше и лучше, но слова на картинках часто неправильные. Это не случайность – это структурная проблема.

Сумасшедшая сцена

Вы используете ИИ для создания красивого рекламного плаката. Композиция идеальна, цветовое сочетание продумано, свет и тень естественны. Потом присмотритесь - «ЛЕТНЯЯ РАСПРОДАЖА» написано как «ЛЕТО САЙЭ», или в слове «Хуэй» в китайском названии «Ограниченное по времени специальное предложение» отсутствует горизонтальная линия.

Однажды ты регенерировал. На этот раз слово «РАСПРОДАЖА» верно, но дата в подзаголовке искажена.

Вы попробуйте еще раз. Дата правильная, но интервал между символами вдруг становится большим и маленьким, а общая раскладка выглядит как пьяная.

Это происходит не потому, что ваши подсказки написаны плохо, и не потому, что модель слишком плоха. Это структурный недостаток нынешней технологии генерации изображений ИИ, и он не исчезнет в ближайшее время.

В этой статье мы рассмотрим проблему, объясним, «почему слова всегда пишутся неправильно» на пяти уровнях, а затем расскажем, почему «позволять ИИ переписывать их» обычно не является лучшим решением.

Первый уровень причины: модель вообще не «распознает» слово

Большинство людей думают, что модели ИИ «сначала понимают текст, а затем рисуют его». Это не так.

Основные модели генерации изображений (Stable Diffusion, DALL-E, Flux и т. д.) используют сегментацию слов BPE — метод кодирования, который разбивает текст на «фрагменты слов». BPE хорошо понимает семантику («Это плакат»), но не очень хорош в точном управлении глифами («Эта буква E, а не F»).

Еще более неприятно то, что кодировщики текста в этих моделях — будь то CLIP или T5 — не предназначены для «точного рисования символов». CLIP предпочитает «выравнивание понятий» (понимание соответствия между изображениями и текстом), а T5 — «понимание языка» (понимание значения предложений). Ни один из них не предназначен для «рендеринга текста на уровне пикселей».

Например: пусть человек с хорошим пониманием, но плохим умением писать, с закрытыми глазами скопирует фрагмент текста на холст. Он примерно знает, что хочет написать, но штрихи, интервалы и размер каждого слова разные. Это базовое состояние текущей модели обработки текста.

Это означает: Независимо от того, как вы оптимизируете слова подсказки, точность текстового элемента управления модели, естественно, имеет верхний предел. Этот верхний предел не может быть превышен с помощью «метода подсказки».

Второй уровень причины: отсутствие «пар глифов» в обучающих данных

Даже если модель способна точно отображать текст, для ее обучения требуется большой объем парных обучающих данных «текст-глиф». Проблема в том, что таких высококачественных данных недостаточно.

На реальных изображениях действительно много текста — уличные знаки, упаковка, плакаты, книги — но шрифтовая аннотация этого текста практически отсутствует. Модель знает, что «на этой картинке есть слова», но не знает, «какой шрифт, какой вес и какой интервал используется для этого слова».

В результате модель может научиться «примерно рисовать слова», но не может научиться «точно контролировать стиль шрифта». Это напрямую приводит к смещению стиля шрифта — если вы попросите без засечек, вам выдадут приблизительный шрифт с засечками; если вы попросите одинаковую толщину на одной и той же леске, вам дадут толще или тоньше.

Ситуация в китайском языке еще серьезнее. Существуют тысячи широко используемых китайских иероглифов, а сложность штрихов намного выше, чем у латинских букв, но китайских текстовых аннотаций в обучающих данных еще меньше. Это объясняет, почему многие модели «хороши» на английском языке, но «часто ошибочны» на китайском.

Третий слой причин: слишком слабый контроль макета

Фрагмент текста на изображении — это не просто «несколько слов», он включает в себя набор геометрических отношений, таких как положение, размер, межстрочный интервал, межсимвольный интервал, выравнивание, базовая линия и т. д. Современные модели плохо контролируют эти геометрические отношения.

В простых сценариях это неочевидно — большой заголовок, название бренда, модель обычно с этим справляется. Но как только текст становится многострочным, имеет несколько текстовых полей и разные уровни набора текста, возникают проблемы:

- Слова иногда расположены далеко, а иногда близко, а межстрочный интервал непостоянен.

- Смещение влево и вправо, смещение базовой линии.

- Относительное положение нескольких текстовых полей неверно.

- Качество текста в заднем ряду длинных абзацев значительно снижено

Академическое сообщество называет эти проблемы в совокупности проблемами «длинного текста» и «множественных текстовых полей», которые в настоящее время являются признанными трудностями. Такие исследования, как EasyText и BizGen, уделяют особое внимание «длинному тексту», «множественному тексту» и «нерегулярным областям», что само по себе показывает, что стабильность этих сценариев далека от решения.

Практическое значение. Если вашему рисунку нужна только подпись в одну строку, искусственный интеллект справится с этой задачей. Если ваше изображение имеет пять или шесть уровней текста (заголовок, подзаголовок, время, место, точка продажи, призыв к действию), и каждый уровень необходимо вводить точно — частота ошибок ИИ резко возрастает.

Четвертый уровень причины: скрытое сжатие пространства не подходит для маленьких символов.

Модель диффузии не работает непосредственно в пространстве пикселей, а генерирует его в сжатом «скрытом пространстве». Это очень дружелюбно к крупным объектам (пейзажам, людям, продуктам) — экономия видеопамяти, экономия вычислительной мощности и высокая эффективность.

Но для мелкого шрифта скрытое сжатие пространства означает потерю высокочастотных деталей. Текст с тонкими штрихами, резкими краями и чрезвычайно низкой допуском ошибок может появиться в процессе сжатия и восстановления:

- Размытые или сломанные штрихи

- неровные края

- После увеличения масштаба появляются «ложные детали» — штрихи, которые выглядят как слова, но на самом деле «воображаются» моделью.

Это объясняет распространенный феномен: большие заголовки, сгенерированные искусственным интеллектом, часто хороши, но мелкий текст (цена, ингредиенты, отказ от ответственности) часто размыт или искажен. Дело не в том, что модель «не хочет» хорошо писать маленькие символы, а в том, что разрешение скрытого пространства ограничивает степень, в которой она «может» хорошо писать маленькие символы.

Логика решения: Сначала исправьте слова, затем увеличьте их. Если вы сначала увеличите, а затем исправите символы, в процессе увеличения модель «заполнит мозг» более ошибочными деталями штрихов, что затруднит ее исправление.

Пятый слой причин: идентификация и предварительная обработка также могут обмануть вас

Даже если слова, сгенерированные ИИ, выглядят «почти правильно», могут возникнуть проблемы при использовании инструмента оптического распознавания символов для их проверки. Это не вина инструмента OCR, но предварительная обработка изображения была выполнена некачественно.

В официальной документации Tesseract четко перечислены четыре вещи, ключевые для успеха или неудачи предварительной обработки OCR: изменение масштаба (масштабирование), бинаризация (бинаризация), шумоподавление и устранение искажений (коррекция). PaddleOCR добавляет три дополнительных переключателя: классификация направления, коррекция текстового изображения и классификация направления текстовой строки.

Другими словами, первопричиной многих «ошибок распознавания OCR» является не сам распознаватель, а геометрия и предварительная обработка изображения. Изображение, перекошенное на 2 градуса, текстовая область с недостаточной контрастностью, фрагмент текста со слишком мягким сглаживанием — все это может привести к тому, что OCR даст совершенно неправильные результаты.

Практические советы. Прежде чем использовать распознавание текста для проверки текста, сгенерированного искусственным интеллектом, выполните следующую предварительную обработку: убедитесь, что контраст в текстовой области достаточный, изображение не сильно наклонено, а края текста не слишком размыты. Это гораздо эффективнее, чем переход на более крупную модель OCR.

Реальность после наложения пяти слоев причин

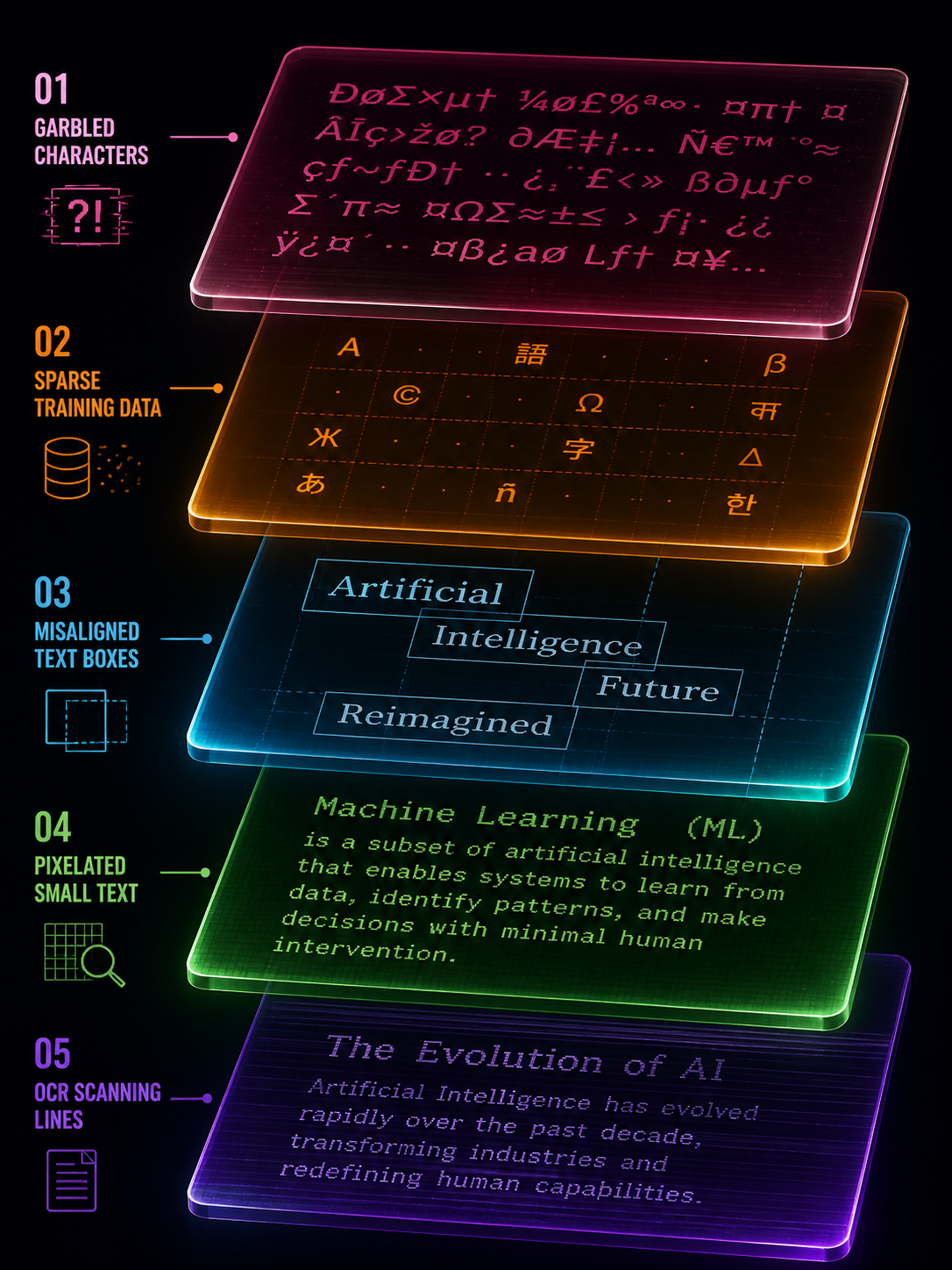

Сложите пять слоев вместе, и вы поймете, почему «написание ИИ» так сложно:

- Кодировщик текста модели не предназначен для точных глифов.

- Отсутствие высококачественных данных для обучения спариванию глифов и шрифтов.

- Слабая возможность геометрического контроля многотекстовой раскладки.

- Скрытое сжатие пространства не подходит для высокочастотных деталей мелких символов.

- Неправильная предобработка изображения приведет к ошибкам при проверке.

Эти пятислойные проблемы не являются дефектами определенной модели, а являются структурными ограничениями всей парадигмы генерации диффузионных изображений. GPT Image 2 намного лучше справляется с рендерингом текста, чем его предшественник, но эти основные ограничения не исчезли — они были устранены лишь частично.

Полезно ли «позволить ИИ переписать это один раз»?

Полезно, но ограничено.

Для коротких сроков показа (3-5 слов заголовков, названий брендов) действительно можно «добить» правильную версию с помощью регенерации. Но по сути это игра вероятностей: каждое поколение представляет собой независимую ничью, и конвергенция не гарантирована.

Для длинных текстов, нескольких текстовых полей и сложных макетов повторная генерация редко решает проблему. Потому что первопричиной является не «случайность», а структурный верхний предел возможностей модели. Вы пробуете еще раз 10 раз и, возможно, 10 раз ошибаетесь в разных местах.

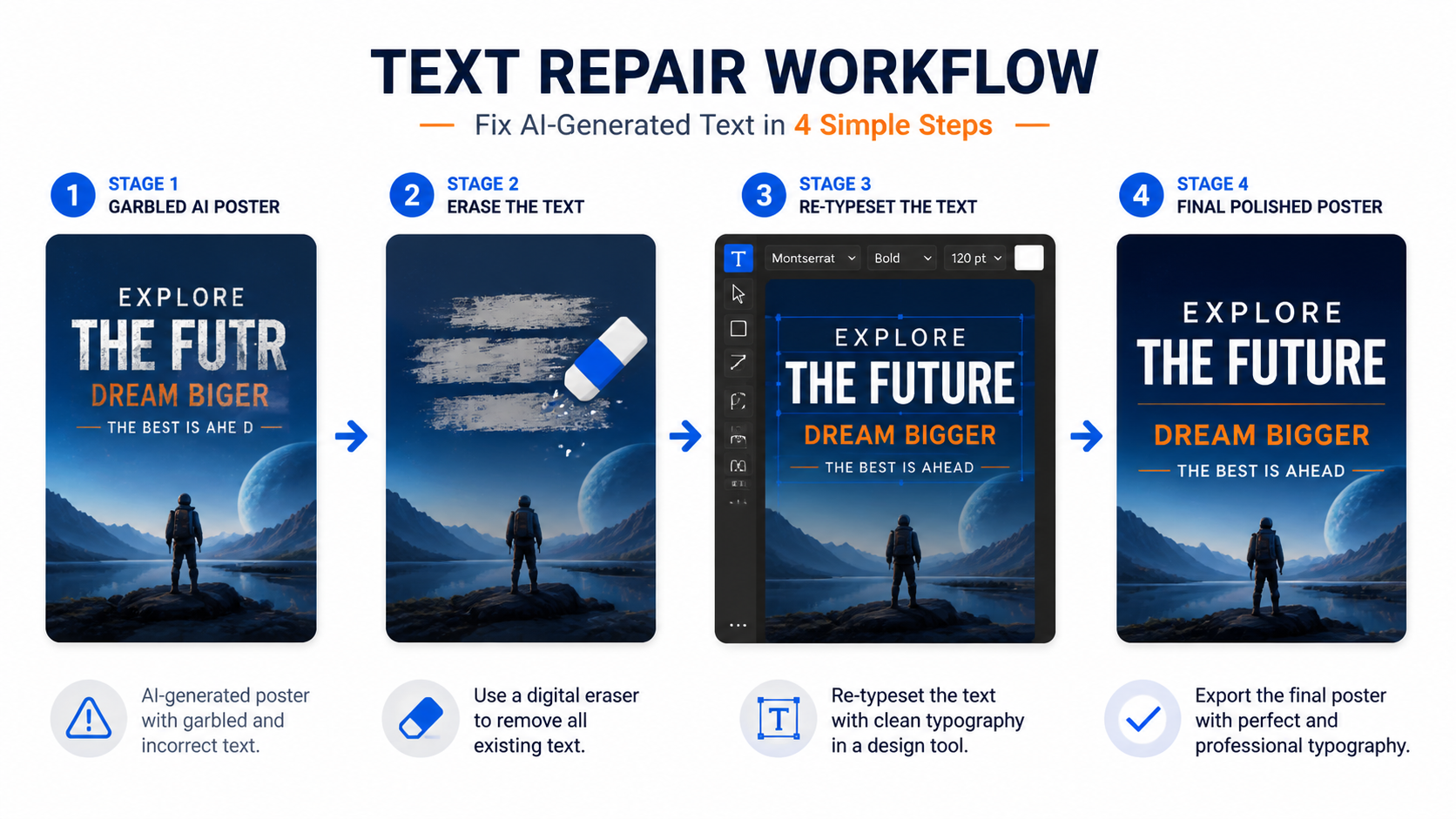

Более стабильный подход — рассматривать текст, сгенерированный ИИ, как «эскиз» — он дает вам приблизительный стиль, макет и атмосферу, но сам текст должен пройти процесс постобработки «стирание — распознавание/вычитка — перестановка — экспорт».

Это не «ИИ плох», а «ИИ отвечает за те части, в которых он хорош (визуальный стиль), а люди и инструменты отвечают за те части, в которых ИИ не хорош (точный текст)».

Уровни риска в разных сценариях

Не весь текст требует одинакового уровня постобработки. По уровню риска:

Низкий риск: декоративный текст для заголовков плакатов и графики для социальных сетей. Этот тип текста более эстетичен, если он «выглядит правильно». Обычно достаточно непосредственного искусственного интеллекта + визуального осмотра. Вы также можете попробовать использовать inpaint для исправления коротких отображаемых слов.

Средний риск: название бренда, название мероприятия, дата, цена. Для такого типа текста требуется «действительно правильно», но слов не так много. Рекомендуется использовать проверку OCR + проверку вручную и использовать локальное редактирование для исправления ошибок.

Высокий риск: списки ингредиентов, нормативный текст, многоязычные этикетки, инфографические данные. Этот тип текста имеет чрезвычайно низкую устойчивость к ошибкам, и ошибка в одной букве или цифре может привести к юридическим проблемам. По умолчанию он вступает в процесс «извлечение OCR + векторная перестановка + поэлементная корректура» и не делает ставку на то, что ИИ сделает все правильно за один раз.

Стандарт оценки очень прост: названиям плакатов можно разрешить «выглядеть так, как будто они расположены правильно»; этикетки и инфографика должны требовать «действительно правильно оформленных».

Краткое описание в одно предложение

Ошибки в тексте, генерируемом ИИ, не случайны, а являются результатом суперпозиции пятиуровневых структурных проблем, таких как кодирование текста, обучающие данные, управление макетом, сжатие скрытого пространства и предварительная обработка. Самая стабильная стратегия — не повторять попытки снова и снова, а относиться к AI-тексту как к эскизу и использовать процесс постобработки «стирать-распознавать-переставлять» для его исправления.

Хотите увидеть реальную разницу в рендеринге текста между разными моделями? Вы можете запустить несколько моделей, используя одно и то же слово-подсказку, на gpt-image-2.live и сравнить точность текста — вы обнаружите, что разрыв больше, чем вы думаете.

Похожие статьи

GPT Image 2 против Nano Banana 2: Величайшая битва ИИ-генераторов изображений, что выбрать?

4 мая 2026 г.

$8 за 100 SKU: Практическое руководство по GPT Image 2 для предметной съемки в e-commerce

3 мая 2026 г.

Преобразование производственных рабочих процессов с помощью возможностей GPT Image 2

27 апр. 2026 г.