AI 生成的图为什么总是写错字?拆开模型看五层病因

AI 测评室

2026年5月4日

你可能已经发现了:AI 画的图越来越好,但图里的字却经常不对。这不是偶然——是结构性问题。

你可能已经发现了:AI 画的图越来越好,但图里的字却经常不对。这不是偶然——是结构性问题。

一个让人抓狂的场景

你用 AI 生成了一张精美的促销海报。构图完美,配色高级,光影自然。然后你定睛一看——"SUMMER SALE" 写成了 "SUMMER SAIE",或者中文标题"限时特惠"里"惠"字少了一横。

你重新生成了一次。这次"SALE"对了,但副标题里的日期变成了乱码。

你又试了一次。日期对了,但字距忽大忽小,整体排版像喝醉了酒。

这不是你提示词写得不好,也不是模型太差。这是当前 AI 图像生成技术的一个结构性短板——而且短期内不会消失。

这篇文章会把这个问题拆开,从五个层面解释"为什么字总是写不对",然后告诉你为什么"让 AI 重写一次"通常不是最好的解决方案。

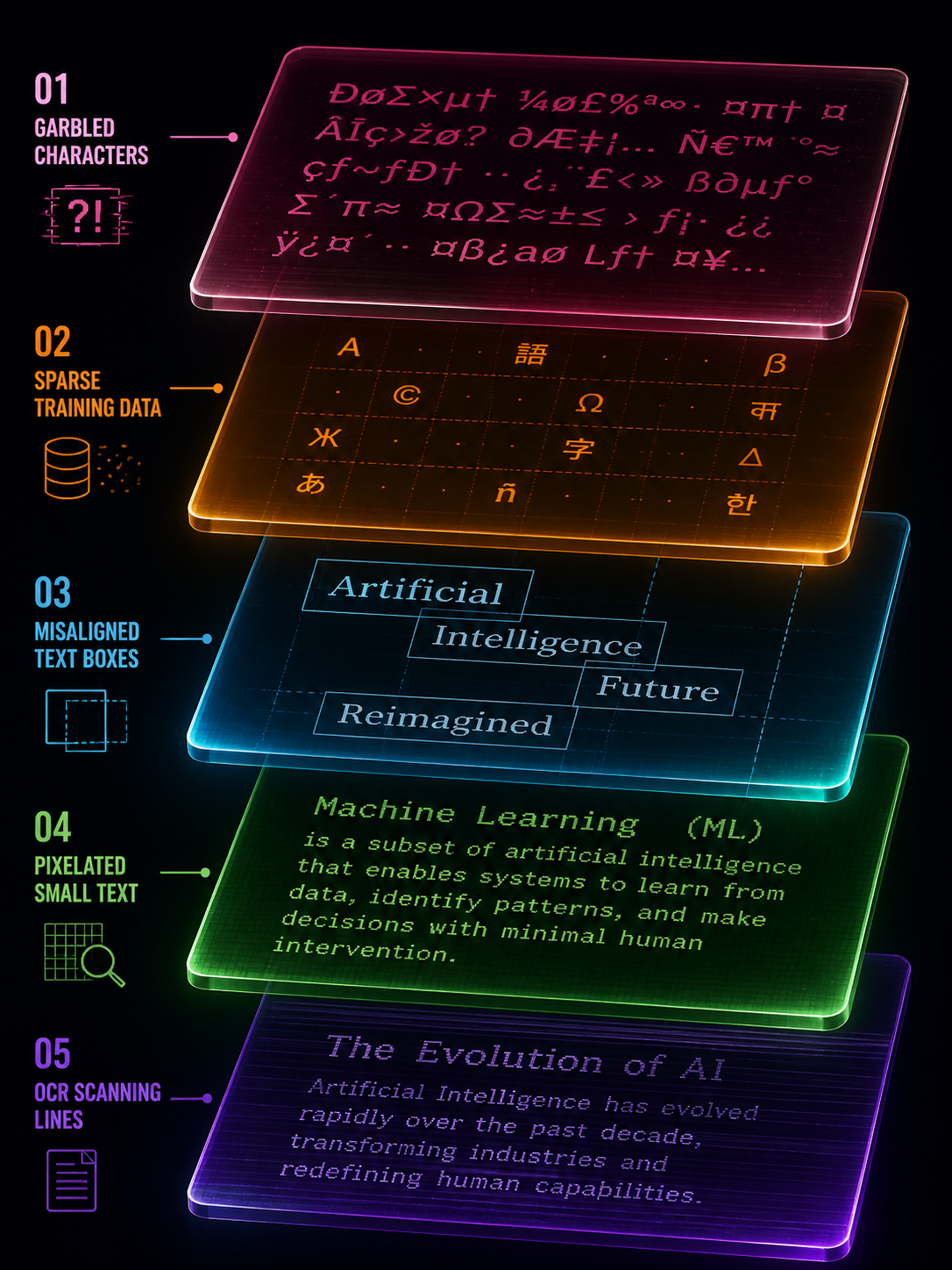

第一层病因:模型根本不"认识"字

大多数人以为 AI 模型是"先理解文字,再画出来"。事实不是这样。

主流图像生成模型(Stable Diffusion、DALL-E、Flux 等)用的是 BPE 分词——一种把文本切成"词片段"的编码方式。BPE 擅长理解语义("这是一张海报"),但不擅长精确控制字形("这个字母是 E 不是 F")。

更麻烦的是,这些模型里的文本编码器——不管是 CLIP 还是 T5——设计初衷都不是"把字符准确画出来"。CLIP 偏向"概念对齐"(理解图片和文字的对应关系),T5 偏向"语言理解"(理解句子的含义)。两者都不是天生为"像素级文字渲染"设计的。

打个比方:让一个理解力很强但写字不太好的人,闭着眼睛在画布上抄写一段文字。他大概知道要写什么,但每个字的笔画、间距、大小都会出偏差。这就是当前模型处理文字的基本状态。

这意味着: 不管你怎么优化提示词,模型对文字的控制精度天然有上限。这个上限不是"提示词技巧"能突破的。

第二层病因:训练数据里缺"字形对"

即使模型有能力精确渲染文字,它也需要大量"文字-字形"的配对训练数据来学习。问题是,这样的高质量数据非常稀缺。

真实世界的图片里确实有很多文字——路牌、包装、海报、书籍——但这些文字的字体标注几乎不存在。模型知道"这张图里有字",但不知道"这个字用的是什么字体、什么字重、什么字距"。

结果就是:模型能学会"大致把字画出来",但学不会"精确控制字体样式"。这直接导致了字体风格漂移——你要求无衬线,它给你画个近似衬线;你要求同一行粗细一致,它给你来个忽粗忽细。

中文的情况更严重。常用汉字几千个,笔画复杂度远高于拉丁字母,但训练数据里的中文文字标注更加稀缺。这就解释了为什么很多模型在英文上"还行",在中文上就"经常出错"。

第三层病因:布局控制太弱

一段文字在图里不只是"几个字",它涉及位置、大小、行距、字距、对齐、基线等一堆几何关系。当前模型对这些几何关系的控制能力很弱。

这在简单场景下不明显——一行大标题、一个品牌名,模型通常能搞定。但一旦变成多行文字、多个文本框、不同层级的排版,问题就爆发了:

- 字忽远忽近,行距不一致

- 左右不对齐,基线漂移

- 多个文本框的相对位置出错

- 长段落的后排文字质量明显下降

学术界把这些统称为"长文本"和"多文本框"问题,是当前公认的难点。像 EasyText、BizGen 这类研究专门把"长文本""多文本""不规则区域"拿出来攻关,本身就说明这些场景的稳定性远未解决。

实际影响: 如果你的图只需要一行大标题,AI 可以胜任。如果你的图有五六个文字层级(标题、副标题、时间、地点、卖点、行动号召),每个层级都需要精确排版——AI 的失败率会急剧上升。

第四层病因:潜空间压缩对小字不友好

扩散模型不是直接在像素空间工作,而是在一个压缩过的"潜空间"里做生成。这对大物体(风景、人物、产品)很友好——省显存、省算力、效率高。

但对小字来说,潜空间压缩意味着高频细节的丢失。笔画细、边缘硬、容错极低的文字,在压缩和还原过程中很容易出现:

- 笔画模糊或断裂

- 边缘锯齿

- 放大后出现"假细节"——看起来像字但实际上是模型"脑补"的笔画

这解释了一个常见现象:AI 生成的大标题通常不错,但小字(价格、成分、免责条款)经常模糊或变形。不是模型"不想"写好小字,是潜空间的分辨率限制了它"能"写好小字的程度。

解决方案的逻辑: 先把字修对,再做放大。如果先放大再修字,放大的过程中模型会"脑补"更多错误的笔画细节,修起来更难。

第五层病因:识别和预处理也会坑你

即使 AI 生成的字看起来"差不多对了",当你用 OCR 工具去校验时,也可能出问题。这不是 OCR 工具的错,而是图像预处理没做好。

Tesseract 官方文档明确把四件事列为 OCR 成败的关键预处理:rescaling(缩放)、binarisation(二值化)、去噪、deskew(纠偏)。PaddleOCR 额外加了方向分类、文本图像矫正和文本行方向分类三个开关。

换句话说,很多"OCR 识别错误"的根因不在识别器本身,而在图像的几何和预处理。一张歪了 2 度的图、一个对比度不够的文本区域、一段抗锯齿过软的文字——都会让 OCR 产出完全错误的结果。

实际操作建议: 在用 OCR 校验 AI 生成的文字之前,先做这些预处理:确保文本区域对比度足够、图像没有明显倾斜、文字边缘没有过度模糊。这比换一个更大的 OCR 模型有效得多。

五层病因叠加后的现实

把五层叠加在一起,你会理解为什么"AI 写字"这件事这么难:

- 模型的文本编码器不是为精确字形设计的

- 缺少高质量的字形-字体配对训练数据

- 多文字布局的几何控制能力弱

- 潜空间压缩对小字的高频细节不友好

- 图像预处理不当会让校验也出错

这五层问题不是某一个模型的缺陷,而是整个扩散式图像生成范式的结构性限制。GPT Image 2 在文字渲染上比前代好了很多,但这些底层限制并没有消失——只是被部分缓解了。

那"让 AI 重写一次"有用吗?

有用,但有限。

对于短展示词(3-5 个单词的标题、品牌名),重新生成确实有可能"碰"到一个正确版本。但这本质上是概率游戏——每次生成都是独立抽签,不保证收敛。

对于长文本、多文本框、复杂排版,重新生成几乎不会改善问题。因为根因不在"随机性",而在模型能力的结构性上限。你重试 10 次,可能 10 次都在不同的地方出错。

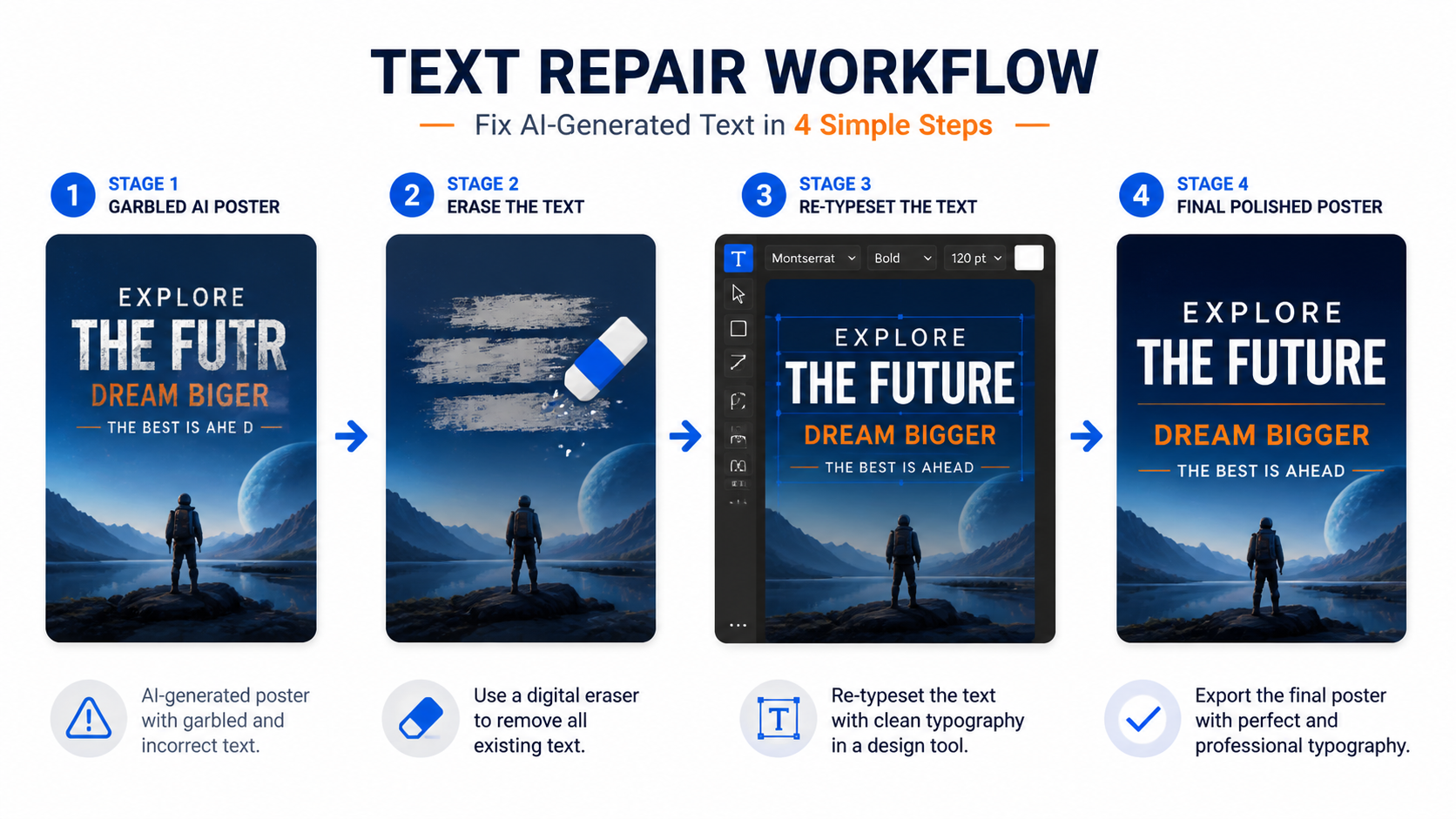

更稳的做法是把 AI 生成的文字当成"草图"——它给你了大致的风格、布局和氛围,但文字本身需要进入一个"擦除—识别/校对—重排—导出"的后处理流程。

这不是"AI 不行",而是"AI 负责它擅长的部分(视觉风格),人和工具负责 AI 不擅长的部分(精确文字)"。

不同场景的风险等级

不是所有文字都需要同等程度的后处理。按风险等级分:

低风险:海报标题、社交媒体图的装饰性文字。 这类文字偏审美,"看起来对了"就可以。AI 直出 + 肉眼检查通常够用。短展示词也可以尝试用 inpaint 局部重绘修正。

中风险:品牌名、活动名、日期、价格。 这类文字要求"真的对了",但字数不多。建议用 OCR 校验 + 人工复核,出错的地方用局部编辑修复。

高风险:成分表、法规文本、多语言标签、信息图数据。 这类文字容错极低,一个字母或数字的错误可能导致法律问题。默认进入"OCR 提取 + 矢量重排 + 逐项校对"流程,不赌 AI 一次写对。

判断标准很简单: 海报标题可以允许"像排对了";标签和信息图必须要求"真的排对了"。

一句话总结

AI 生成的文字出错不是偶然,而是文本编码、训练数据、布局控制、潜空间压缩和预处理五层结构性问题的叠加。最稳的策略不是反复重试,而是把 AI 的文字当草图,用"擦除—识别—重排"的后处理流程把它修对。

想看看不同模型在文字渲染上的真实差距?可以在 gpt-image-2.live 上用同一个提示词分别跑几个模型,对比文字准确率——你会发现差距比你想象的大。