なぜ AI で生成された画像には常にタイプミスが含まれるのでしょうか?モデルを分解して原因の 5 つの層を確認する

AI 测评室

2026年5月4日

AI によって描かれた絵はますます良くなっていることに気づいたかもしれませんが、絵の中の言葉は間違っていることがよくあります。これは事故ではなく、構造的な問題です。

#なぜAIが生成した写真にはいつもタイプミスがあるのでしょうか?モデルを分解して原因の 5 つの層を確認する

もうお気づきかもしれませんが、AI によって描かれた絵はどんどん良くなっていきますが、絵の中の言葉は間違っていることがよくあります。これは事故ではなく、構造的な問題です。

クレイジーなシーン

AI を使用して美しい宣伝ポスターを生成します。構図は完璧で、カラーマッチングは高度で、光と影は自然です。次に、よく見てみると、「SUMMER SALE」が「SUMMER SAIE」と書かれていたり、「期間限定特別オファー」という中国語のタイトルの「Hui」という単語に横線が欠けていたりすることがあります。

一度再生したんですね。今度は「SALE」は正しいのですが、サブタイトルの日付が文字化けしてしまいました。

もう一度試してみます。日付は合っているのですが、字間が急に広くなったり狭くなったり、全体的に酔っぱらいのようなレイアウトになっています。

これは、プロンプトの言葉がうまく書かれていないためでも、モデルが悪すぎるためでもありません。これは現在の AI 画像生成テクノロジーの構造的な欠陥であり、すぐに消えることはありません。

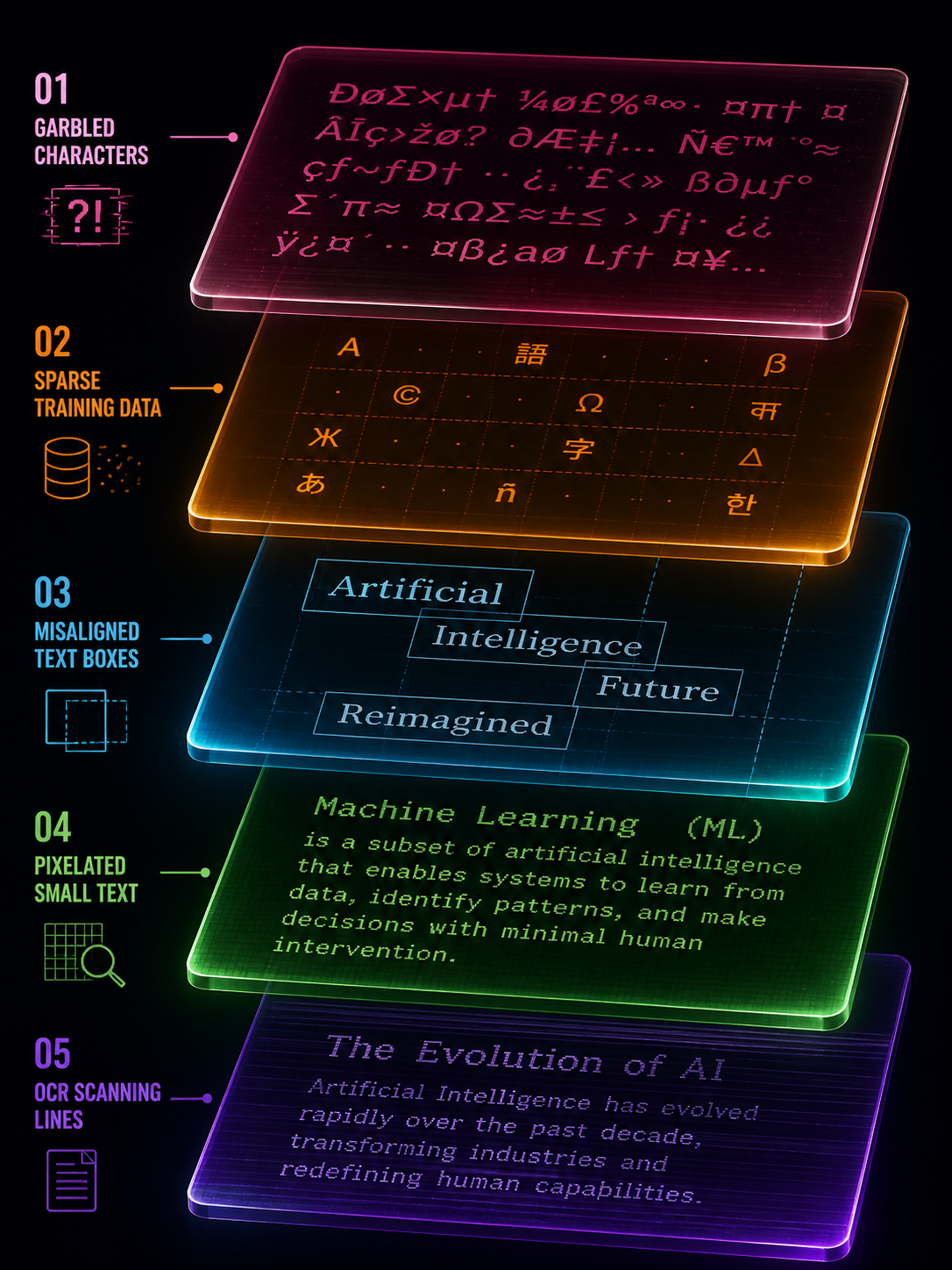

この記事では、問題を分解し、「単語が常に間違って書かれる理由」を 5 つのレベルで説明し、「AI に書き換えさせる」ことが通常最善の解決策ではない理由を説明します。

原因の第 1 レベル: モデルが単語をまったく「認識」しない

ほとんどの人は、AI モデルが「まずテキストを理解してから描画する」と考えています。これは事実ではありません。

主流の画像生成モデル (安定拡散、DALL-E、Flux など) は、テキストを「単語フラグメント」に分割するコーディング方法である BPE 単語セグメンテーションを使用します。 BPE はセマンティクス (「これはポスターです」) を理解するのは得意ですが、グリフを正確に制御すること (「この文字は F ではなく E です」) は苦手です。

さらに問題なのは、CLIP であれ T5 であれ、これらのモデルのテキスト エンコーダは「文字を正確に描画する」ように設計されていないことです。 CLIPは「概念の一致」(画像とテキストの対応関係の理解)を重視し、T5は「言語理解」(文章の意味の理解)を重視します。どちらも「ピクセルレベルのテキストレンダリング」用に設計されていません。

たとえば、理解力はあるが文章を書く能力が低い人が、目を閉じてキャンバス上のテキストをコピーするとします。書きたいことは大体わかっているのですが、文字の画数、文字間、大きさがすべて異なります。これは、テキストを処理するための現在のモデルの基本的な状態です。

これは次のことを意味します: プロンプトの単語をどのように最適化しても、モデルのテキスト コントロールの精度には当然ながら上限があります。この上限を「即言術」では超えることはできません。

原因の第 2 レベル: トレーニング データに「グリフ ペア」が存在しないこと

モデルがテキストを正確にレンダリングできる場合でも、学習するには大量の「テキストとグリフ」のペアのトレーニング データが必要です。問題は、そのような高品質のデータが不足していることです。

道路標識、パッケージ、ポスター、書籍など、実際の画像には確かに多くのテキストが含まれていますが、このテキストのフォント注釈はほとんど存在しません。モデルは「この絵の中に単語がある」ことは知っていますが、「この単語にどのようなフォント、太さ、間隔が使用されているか」は知りません。

その結果、モデルは「単語を大まかに描画する」ことは学習できますが、「フォント スタイルを正確に制御する」ことは学習できません。これはフォント スタイルのドリフトに直接つながります。サンセリフを要求すると、おおよそのセリフが表示されます。同じラインで同じ太さを要求すると、より厚いか薄いものが提供されます。

中国語の状況はさらに深刻だ。一般的に使用される漢字は何千もあり、ストロークの複雑さはラテン文字よりもはるかに高いですが、トレーニング データ内の中国語テキストの注釈はさらに希少です。これは、多くのモデルが英語では「OK」であるのに、中国語では「頻繁に間違っている」理由を説明しています。

原因の第 3 層: レイアウト制御が弱すぎる

画像内のテキストは単なる「単語」ではなく、位置、サイズ、行間、文字間隔、配置、ベースラインなどの幾何学的な関係が多数含まれています。現在のモデルでは、これらの幾何学的な関係の制御が不十分です。

これは、単純なシナリオでは明らかではありません。大きな見出し、ブランド名、モデルは通常、それを処理できます。しかし、複数行のテキスト、複数のテキスト ボックス、さまざまなレベルの組版になると、次の問題が発生します。

・左右のズレ、ベースラインのズレ

- 言葉が遠いときもあれば近いときもあり、行間も一定ではない

- 複数のテキストボックスの相対位置が間違っている

- 長い段落の後列のテキストの品質が大幅に低下します

学術界ではこれらを総称して「長いテキスト」問題と「複数のテキストボックス」問題と呼び、現在では困難であると認識されています。 EasyText や BizGen などの研究は、特に「長いテキスト」、「複数のテキスト」、「不規則な領域」に焦点を当てていますが、これ自体、これらのシナリオの安定性が解決には程遠いことを示しています。

実用的な効果: 図に 1 行のキャプションのみが必要な場合は、AI がその仕事を行うことができます。画像に 5 つまたは 6 つのレベルのテキスト (タイトル、サブタイトル、時間、場所、セールスポイント、行動喚起) があり、各レベルを正確に入力する必要がある場合、AI の失敗率は劇的に上昇します。

原因の 4 番目の層: 潜在スペース圧縮は小さな文字には適していません

拡散モデルはピクセル空間では直接機能しませんが、圧縮された「潜在空間」で生成されます。これは、大きなオブジェクト (風景、人物、製品) に非常に適しており、ビデオ メモリを節約し、計算能力を節約し、効率を高めます。

しかし、小さな印刷物の場合、潜在スペースの圧縮は高周波の細部の損失を意味します。細いストローク、硬いエッジ、およびエラー許容度が非常に低いテキストは、圧縮および復元プロセス中に表示される傾向があります。

- ぼやけた、または壊れたストローク

- ギザギザのエッジ

- ズームインすると「偽の詳細」が表示されます - 単語のように見えますが、実際にはモデルによって「想像」されたストローク

これは、一般的な現象の説明になります。AI によって生成された大きな見出しは優れていることが多いですが、小さなテキスト (価格、成分、免責事項) はぼやけたり歪んだりすることがよくあります。それはモデルが小さな文字をうまく書くことを「望まない」ということではなく、潜在空間の解像度によって小さな文字をうまく書くことができる程度が制限されるということです。

解決策の論理: まず単語を修正してから拡大します。最初に拡大してから文字を修正すると、拡大プロセス中にモデルがより多くの誤ったストロークの詳細を「脳内補完」するため、修復がより困難になります。

原因の第 5 層: 特定と前処理でも騙される可能性がある

AI によって生成された単語が「ほぼ正しい」ように見えても、OCR ツールを使用して検証すると問題が発生する可能性があります。これは OCR ツールのせいではありませんが、画像の前処理が適切に行われていませんでした。

Tesseract の公式ドキュメントでは、OCR の成功または失敗を決定する重要な前処理として、リスケーリング (スケーリング)、バイナリゼーション (2 値化)、ノイズ除去、デスキュー (補正) の 4 つが明確にリストされています。 PaddleOCR には、方向分類、テキスト画像補正、テキスト行方向分類という 3 つのスイッチが追加されています。

言い換えれば、多くの「OCR 認識エラー」の根本原因は、認識装置自体ではなく、画像のジオメトリと前処理にあります。 2 度傾いた画像、コントラストが不十分なテキスト領域、アンチエイリアシングが柔らかすぎるテキストなど、すべてが OCR で完全に間違った結果を生成する原因となる可能性があります。

実践的な提案: OCR を使用して AI によって生成されたテキストを検証する前に、次の前処理を行ってください。テキスト領域のコントラストが十分であること、画像が大きく傾いていないこと、テキストの端が過度にぼやけていないことを確認してください。これは、より大きな OCR モデルに切り替えるよりもはるかに効果的です。

原因を5層に重ねた後の現実

5 つのレイヤーを積み重ねると、「AI ライティング」がなぜ非常に難しいのかがわかります。

- モデルのテキスト エンコーダーは、正確なグリフ用に設計されていません

- 高品質のグリフとフォントの組み合わせトレーニング データの欠如

- マルチテキストレイアウトの幾何学的制御能力が弱い

- 潜在スペース圧縮は、小さな文字の高周波の詳細には適していません。

- 画像の前処理が不適切だと検証エラーが発生する

これらの 5 層の問題は、特定のモデルの欠陥ではなく、拡散画像生成パラダイム全体の構造上の制限です。 GPT Image 2 は、以前のバージョンよりもテキストのレンダリングがはるかに優れていますが、これらの根本的な制限は消えておらず、部分的に緩和されているだけです。

「AI に一度書き換えてもらう」は役に立つでしょうか?

便利ですが、制限があります。

短い表示用語 (3 ~ 5 語のタイトル、ブランド名) の場合は、再生成によって正しいバージョンを「ヒット」することが実際に可能です。しかし、これは本質的に確率のゲームであり、各世代は独立した抽選であり、収束は保証されません。

長いテキスト、複数のテキスト ボックス、複雑なレイアウトの場合、再生成しても問題が改善されることはほとんどありません。なぜなら、根本的な原因は「ランダム性」ではなく、モデルの能力の構造的な上限にあるからです。 10 回再試行すると、おそらく 10 回、別の場所で間違ってしまいます。

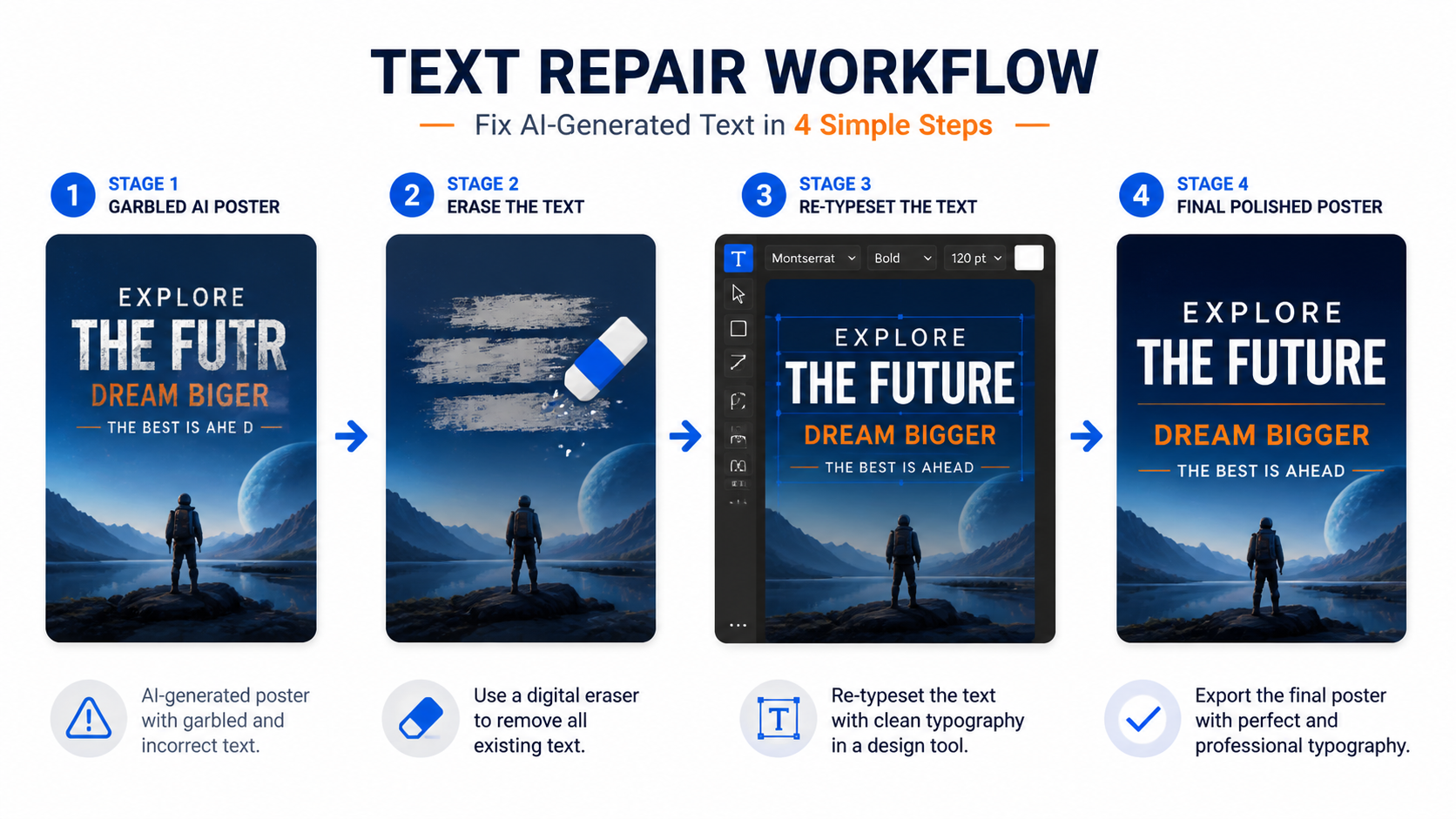

より安定したアプローチは、AIによって生成されたテキストを「スケッチ」として扱うことです。大まかなスタイル、レイアウト、雰囲気は得られますが、テキスト自体は「消去 - 認識/校正 - 並べ替え - エクスポート」という後処理プロセスに入る必要があります。

これは「AIが苦手」ではなく、「AIが得意な部分(ビジュアルスタイル)はAIが担当し、AIが苦手な部分(正確なテキスト)は人やツールが担当する」ということです。

さまざまなシナリオにおけるリスク レベル

すべてのテキストに同じレベルの後処理が必要なわけではありません。リスクレベルに応じて:

低リスク: ポスター タイトルの装飾テキスト、ソーシャル メディア グラフィック。 このタイプのテキストは、「正しく見える」限り、より審美的です。通常は、AI そのまま + 目視検査で十分です。インペイントを使用して短い表示単語を修正することもできます。

中リスク: ブランド名、イベント名、日付、価格。 このタイプのテキストは「本当に正しい」ことが必要ですが、単語数はそれほど多くありません。 OCR 検証と手動レビューを使用し、ローカル編集を使用してエラーを修復することをお勧めします。

高リスク: 成分リスト、規制文書、多言語ラベル、インフォグラフィック データ。 このタイプのテキストはエラー許容度が非常に低く、単一の文字または数字のエラーが法的問題につながる可能性があります。デフォルトでは、「OCR 抽出 + ベクトル再配置 + 項目ごとの校正」プロセスに入り、AI が一度で正しく処理できるかどうかは賭けません。

判断基準は非常にシンプルです。 ポスターのタイトルは「正しく配置されているように見える」ことが許容されます。ラベルとインフォグラフィックスは「本当に正しく配置されている」必要があります。

一文の要約

AIによって生成されたテキストのエラーは偶然ではなく、テキストのエンコード、トレーニングデータ、レイアウト制御、潜在空間圧縮、前処理などの5層構造の問題が重なって発生します。最も安定した戦略は、何度も再試行するのではなく、AI テキストをスケッチとして扱い、「消去 - 認識 - 再配置」の後処理プロセスを使用して修正することです。

異なるモデル間のテキストレンダリングの実際の違いを確認したいですか? gpt-image-2.live で同じプロンプト ワードを使用して複数のモデルを実行し、テキストの精度を比較できます。ギャップが思ったよりも大きいことがわかります。