AI 產生的圖為什麼總是寫錯字?拆開模型看五層病因

AI 测评室

2026年5月4日

你可能已經發現了:AI 畫的圖越來越好,但圖裡的字卻常常不對。這不是偶然——是結構性問題。

你可能已經發現了:AI 畫的圖越來越好,但圖裡的字卻常常不對。這不是偶然——是結構性問題。

一個讓人抓狂的場景

你用 AI 產生了一張精美的促銷海報。構圖完美,配色高級,光影自然。然後你定睛一看--"SUMMER SALE" 寫成了 "SUMMER SAIE",或是中文標題"限時特惠"裡"惠"字少了一橫。

你重新生成了一次。這次"SALE"對了,但副標題裡的日期變成了亂碼。

你又試了一次。日期對了,但字距忽大忽小,整體排版像喝醉了酒。

這不是你提示詞寫得不好,也不是模型太差。這是目前 AI 影像生成技術的一個結構性短板——而且短期內不會消失。

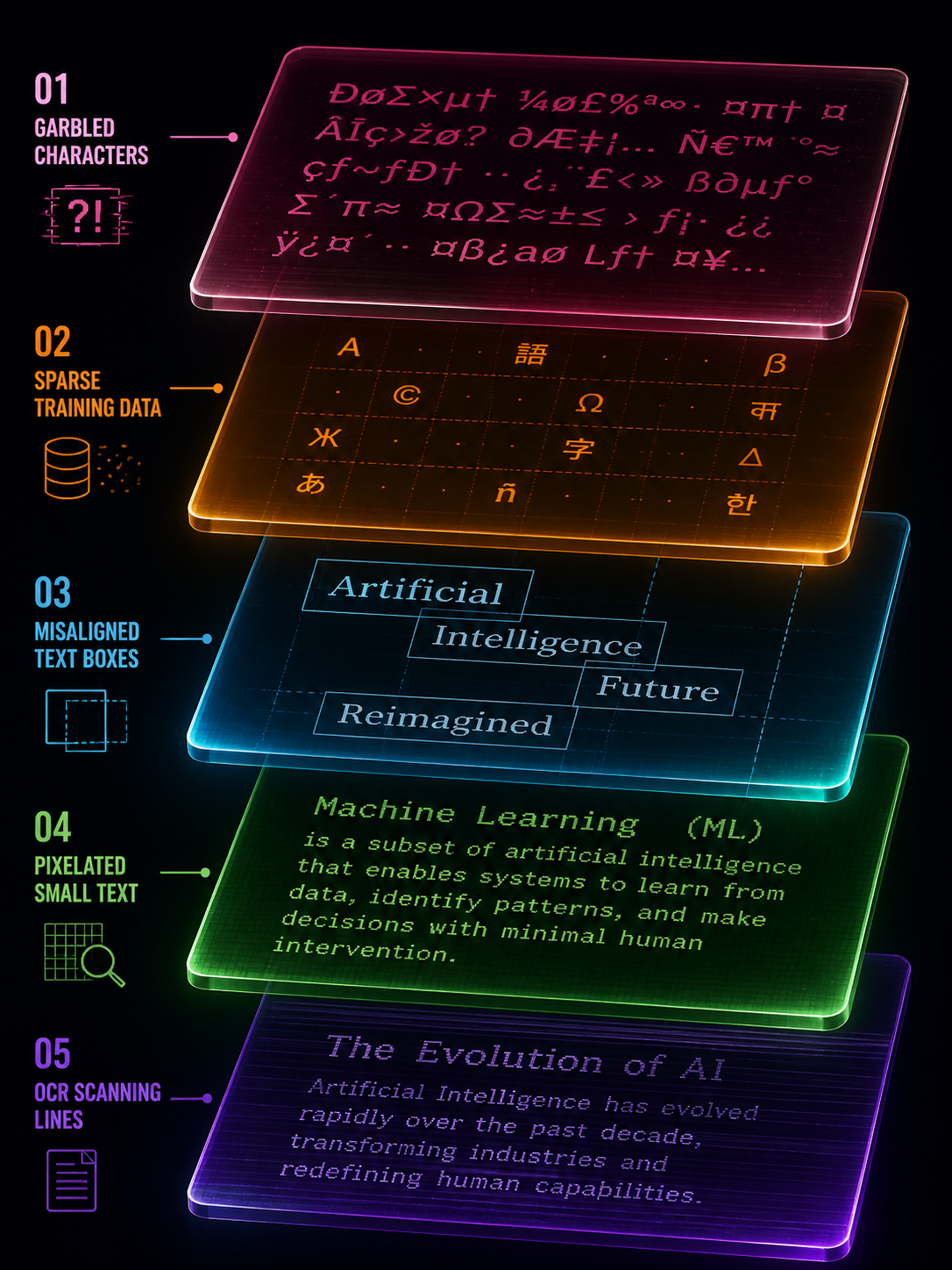

這篇文章會把這個問題拆開,從五個層面解釋"為什麼字總是寫不對",然後告訴你為什麼"讓 AI 重寫一次"通常不是最好的解決方案。

第一層病因:模型根本不"認識"字

大多數人以為 AI 模型是"先理解文字,再畫出來"。事實不是這樣。

主流圖像生成模型(Stable Diffusion、DALL-E、Flux 等)用的是 BPE 分詞——一種把文本切成"詞片段"的編碼方式。 BPE 擅長理解語意("這是一張海報"),但不擅長精確控製字形("這個字母是 E 不是 F")。

更麻煩的是,這些模型裡的文本編碼器——不管是 CLIP 還是 T5——設計初衷都不是"把字符準確畫出來"。 CLIP 偏向"概念對齊"(理解圖片和文字的對應關係),T5 偏向"語言理解"(理解句子的含義)。兩者都不是天生為"像素級文字渲染"設計的。

打個比方:讓一個理解力很強但寫字不太好的人,閉著眼睛在畫布上抄寫一段文字。他大概知道要寫什麼,但每個字的筆畫、間距、大小都會偏離。這就是目前模型處理文字的基本狀態。

這表示: 不管你怎麼優化提示詞,模型對文字的控制精度天然有上限。這個上限不是"提示詞技巧"能突破的。

第二層病因:訓練資料裡缺"字形對"

即使模型有能力精確渲染文字,它也需要大量"文字-字形"的配對訓練資料來學習。問題是,這樣的高品質數據非常稀缺。

真實世界的圖片裡確實有很多文字——路牌、包裝、海報、書籍——但這些文字的字體標註幾乎不存在。模型知道"這張圖裡有字",但不知道"這個字用的是什麼字體、什麼字重、什麼字距"。

結果就是:模型能學會"大致把字畫出來",但學不會"精確控製字體樣式"。這直接導致了字體風格漂移——你要求無襯線,它給你畫個近似襯線;你要求同一行粗細一致,它給你來個忽粗忽細。

中文的情況更嚴重。常用漢字幾千個,筆畫複雜度遠高於拉丁字母,但訓練資料裡的中文文字標註更稀少。這就解釋了為什麼很多模型在英文上"還行",在中文上就"經常出錯"。

第三層病因:佈局控制太弱

一段文字在圖裡不只是"幾個字",它涉及位置、大小、行距、字距、對齊、基線等一堆幾何關係。目前模型對這些幾何關係的控制能力很弱。

這在簡單場景下並不明顯──一行大標題、一個品牌名,模型通常能搞定。但一旦變成多行文字、多個文字方塊、不同層級的排版,問題就爆發了:

- 字忽遠忽近,行距不一致

- 左右不對齊,基線漂移

- 多個文字方塊的相對位置出錯

- 長段落的後排文字品質明顯下降

學術界把這些統稱為"長文本"和"多文本框"問題,是當前公認的困難點。像 EasyText、BizGen 這類研究專門把"長文本""多文本""不規則區域"拿出來攻關,本身就說明這些場景的穩定性遠未解決。

實際影響: 如果你的圖只需要一行大標題,AI 可以勝任。如果你的圖有五、六個文字層級(標題、副標題、時間、地點、賣點、行動號召),每個層級都需要精確排版-AI 的失敗率會急遽上升。

第四層病因:潛空間壓縮對小字不友善

擴散模型不是直接在像素空間工作,而是在一個壓縮過的"潛空間"裡做生成。這對大物體(風景、人物、產品)很友善——省顯存、省算力、效率高。

但對小字來說,潛空間壓縮意味著高頻細節的喪失。筆畫細、邊緣硬、容錯極低的文字,在壓縮和還原過程中很容易出現:

- 筆畫模糊或斷裂

- 邊緣鋸齒

- 放大後出現"假細節"——看起來像字但實際上是模型"腦補"的筆畫

這解釋了一個常見現象:AI 生成的大標題通常不錯,但小字(價格、成分、免責條款)經常模糊或變形。不是模型"不想"寫好小字,是潛空間的分辨率限制了它"能"寫好小字的程度。

解決方案的邏輯: 先把字修對,再放大。如果先放大再修字,放大的過程中模型會"腦補"更多錯誤的筆畫細節,修起來更難。

第五層病因:辨識和預處理也會坑你

即使 AI 產生的字看起來"差不多對了",當你用 OCR 工具去校驗時,也可能出問題。這不是 OCR 工具的錯,而是影像預處理沒做好。

Tesseract 官方文件明確將四件事列為 OCR 成敗的關鍵預處理:rescaling(縮放)、binarisation(二值化)、去噪、deskew(糾偏)。 PaddleOCR 額外增加了方向分類、文字影像矯正和文字行方向分類三個開關。

換句話說,很多"OCR 辨識錯誤"的根因不在辨識器本身,而在影像的幾何和預處理。一張歪了 2 度的圖、一個對比度不夠的文字區域、一段抗鋸齒過軟的文字——都會讓 OCR 產出完全錯誤的結果。

實際操作建議: 在用 OCR 校驗 AI 產生的文字之前,先做這些預處理:確保文字區域對比度足夠、影像沒有明顯傾斜、文字邊緣沒有過度模糊。這比換一個更大的 OCR 模型有效得多。

五層病因疊加後的現實

把五層疊在一起,你會理解為什麼"AI 寫字"這件事這麼難:

- 模型的文字編碼器不是為精確字形設計的

- 缺少高品質的字形-字體配對訓練數據

- 多文字佈局的幾何控制能力弱

- 潛空間壓縮對小字的高頻細節不友善

- 影像預處理不當會讓校驗也出錯

這五層問題不是某一個模型的缺陷,而是整個擴散式影像生成範式的結構性限制。 GPT Image 2 在文字渲染上比前代好了很多,但這些底層限制並沒有消失——只是被部分緩解了。

那"讓 AI 重寫一次"有用嗎?

有用,但有限。

對於短展示詞(3-5 個單字的標題、品牌名稱),重新生成確實有可能"碰"到一個正確版本。但這本質上是機率遊戲——每次生成都是獨立抽籤,不保證收斂。

對於長文本、多文字方塊、複雜排版,重新產生幾乎不會改善問題。因為根因不在"隨機性",而在模型能力的結構性上限。你重試 10 次,可能 10 次都在不同的地方出錯。

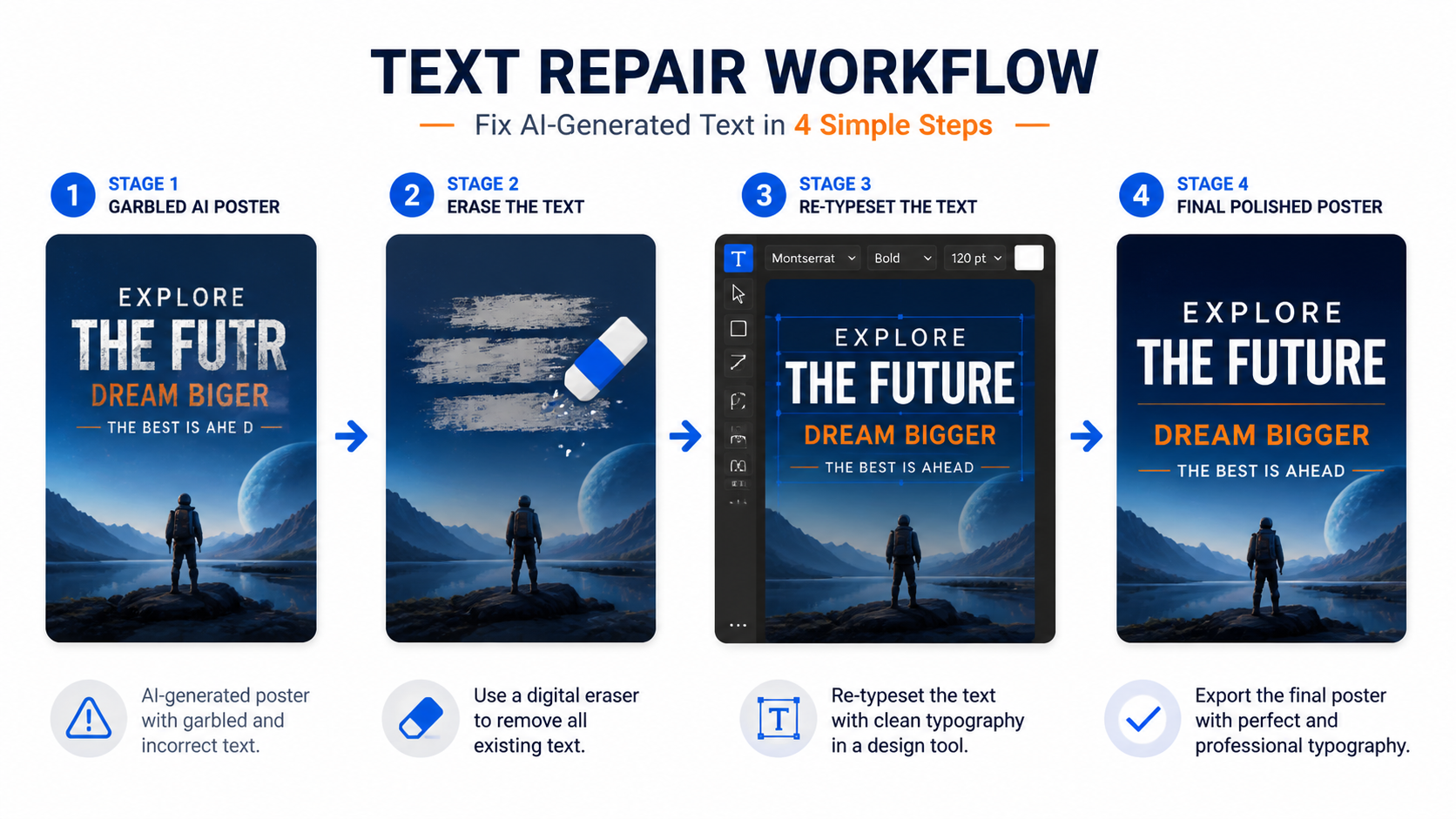

更穩的做法是把 AI 生成的文字當成"草圖"——它給你了大致的風格、佈局和氛圍,但文字本身需要進入一個"擦除—識別/校對—重排—導出"的後處理流程。

這不是"AI 不行",而是"AI 負責它擅長的部分(視覺風格),人和工具負責 AI 不擅長的部分(精確文字)"。

不同場景的風險等級

不是所有文字都需要同等程度的後製。按風險等級分:

低風險:海報標題、社群媒體圖的裝飾文字。 這類文字偏審美,"看起來對了"就可以。 AI 直出 + 肉眼檢查通常夠用。短展示詞也可以嘗試用 inpaint 局部重繪修正。

中風險:品牌名稱、活動名稱、日期、價格。 這類文字要求"真的對了",但字數不多。建議用 OCR 校驗 + 人工複核,出錯的地方用局部編輯修復。

高風險:成分錶、法規文字、多語言標籤、資訊圖表資料。 這類文字容錯極低,一個字母或數字的錯誤可能導致法律問題。預設進入"OCR 提取 + 向量重排 + 逐項校對"流程,不賭 AI 一次寫對。

判斷標準很簡單: 海報標題可以允許"像排對了";標籤和資訊圖表必須要求"真的排對了"。

一句話總結

AI 產生的文字出錯不是偶然,而是文字編碼、訓練資料、佈局控制、潛空間壓縮和預處理五層結構性問題的疊加。最穩的策略不是反覆重試,而是把 AI 的文字當草圖,用"擦除—識別—重排"的後處理流程把它修對。

想看看不同模型在文字渲染上的真實差距?可以在 gpt-image-2.live 上用同一個提示詞分別跑幾個模型,對比文字準確率——你會發現差距比你想像的大。